Le problème de 30 ans que Willow vient de résoudre

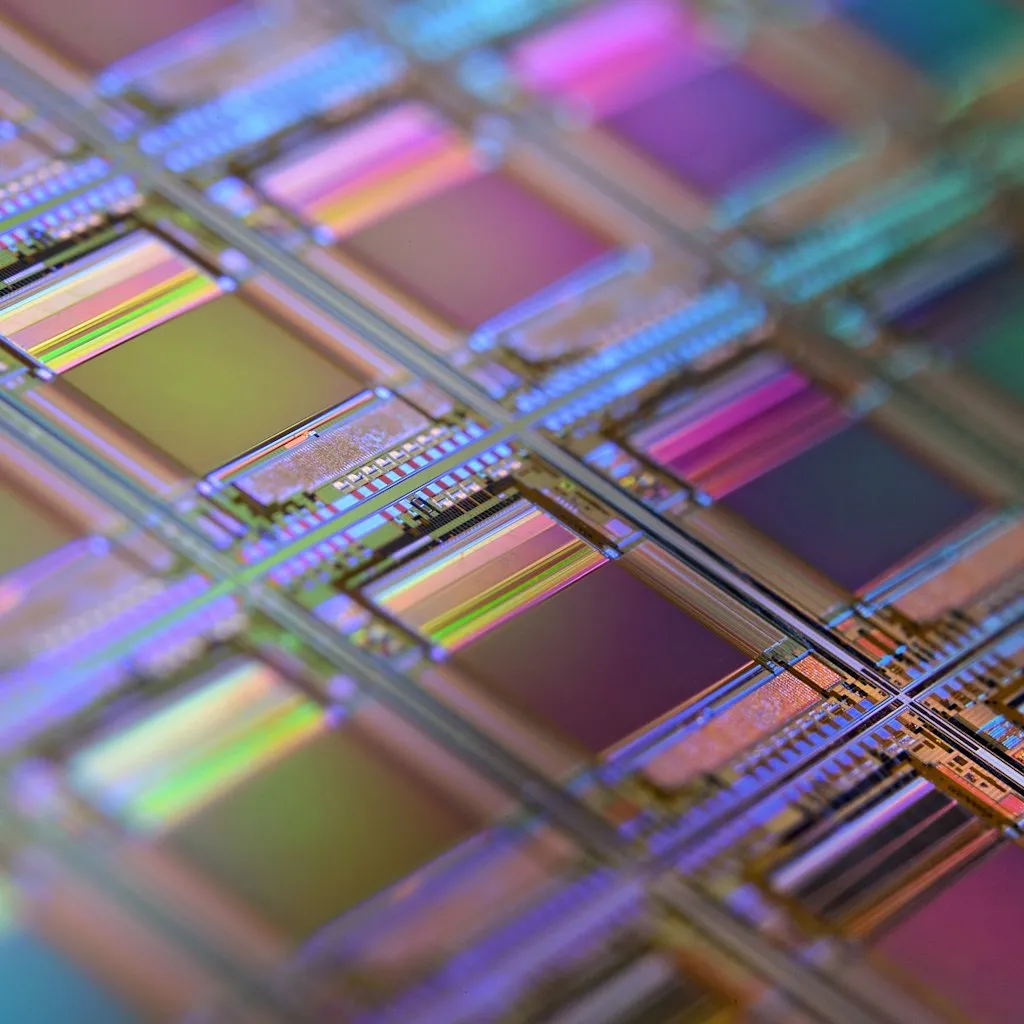

Depuis que Peter Shor a introduit la correction d’erreurs quantiques en 1995, les physiciens poursuivent un objectif apparemment paradoxal : ajouter plus de qubits à un système quantique tout en le rendant moins sujet aux erreurs plutôt que davantage. Pendant trois décennies, chaque tentative d’augmenter la taille des processeurs quantiques a amplifié le bruit plus vite que la correction d’erreurs ne pouvait le supprimer. En décembre 2024, l’équipe Quantum AI de Google a annoncé dans Nature que leur processeur Willow à 105 qubits avait enfin franchi cette barrière.

La percée s’appelle correction d’erreurs « sous le seuil ». Google a testé des tableaux de code de surface de tailles croissantes — grilles de 3×3, 5×5 et 7×7 qubits — et a démontré que chaque augmentation de taille de grille réduisait le taux d’erreur encodé d’un facteur 2,14. La tendance est exponentielle : doublez la grille, divisez les erreurs par deux. C’est l’exigence fondamentale pour construire un ordinateur quantique tolérant aux pannes, et personne ne l’avait réalisé dans un système supraconducteur avant Willow.

Ce que signifie réellement le benchmark

Le chiffre phare de Google est spectaculaire : Willow a complété un benchmark Random Circuit Sampling (RCS) en moins de cinq minutes qui prendrait au supercalculateur le plus rapide du monde 10 septillions (10^25) d’années — une durée dépassant largement l’âge de l’univers. Le chiffre est réel, vérifié et publié dans Nature.

Mais le contexte compte. Le RCS est un benchmark spécifiquement conçu pour être exponentiellement difficile pour les ordinateurs classiques. Il ne résout aucun problème pratique connu. Il prouve que le matériel quantique peut surpasser le matériel classique sur au moins une tâche — un jalon scientifique important, mais pas l’équivalent de l’informatique quantique utile. Google a été transparente sur cette distinction, positionnant Willow comme la deuxième étape d’une feuille de route en six jalons vers les applications quantiques commerciales.

Publicité

Au-delà du seuil de rentabilité : pourquoi les qubits logiques comptent

L’accomplissement le plus conséquent est ce que Google appelle « au-delà du seuil de rentabilité ». Le qubit logique de Willow — l’unité corrigée des erreurs qui encode l’information à travers plusieurs qubits physiques — a atteint une durée de vie plus de deux fois supérieure à celle de son meilleur qubit physique constitutif. Cela signifie que le système de correction d’erreurs améliore réellement les performances du matériel, et ne se contente pas de les compenser.

Le système a fonctionné pendant jusqu’à un million de cycles de correction d’erreurs sur plusieurs heures tout en décodant les erreurs en temps réel et en maintenant les performances. Ce fonctionnement soutenu démontre une maturité d’ingénierie, pas simplement une expérience de physique ponctuelle.

En octobre 2025, Google a suivi en démontrant un avantage quantique dans l’optimisation de portefeuille — résolvant des problèmes d’optimisation financière 13 000 fois plus vite que les supercalculateurs classiques — la première application réelle où Willow a montré une valeur pratique au-delà des benchmarks.

La course est lancée : IBM, Microsoft et la route vers la tolérance aux pannes

Willow n’existe pas dans un vide. IBM vise un avantage quantique vérifié d’ici fin 2026 avec son processeur Nighthawk à 120 qubits et déploie déjà des systèmes Condor à 433 qubits pour la recherche. Microsoft a dévoilé des qubits topologiques, une approche physique entièrement différente qui échange le nombre actuel de qubits contre une meilleure résilience aux erreurs à l’échelle.

Le goulot d’étranglement commun est le même : l’informatique quantique tolérante aux pannes nécessitera probablement des millions de qubits physiques, pas des centaines. Les 105 qubits de Willow sont une preuve de concept, pas un système de production. Google a ouvert un programme d’accès anticipé Willow (propositions attendues avant le 15 mai 2026) pour les chercheurs externes, signalant que la prochaine phase est l’expérimentation collaborative, pas le déploiement commercial.

Ce que cela change pour l’industrie

La percée en correction d’erreurs de Willow fait passer la conversation sur l’informatique quantique de « si » à « quand ». Avant Willow, la question centrale du domaine était de savoir si la correction d’erreurs quantiques pouvait fonctionner dans du matériel supraconducteur à une échelle significative. Cette question a maintenant sa réponse. Les questions restantes — comment passer de 105 à des millions de qubits, comment réduire les coûts et quelles applications atteindront la viabilité commerciale en premier — sont des problèmes d’ingénierie, pas des énigmes de physique.

Pour les entreprises, le calendrier pratique reste long. La plupart des experts projettent des ordinateurs quantiques commercialement utiles et tolérants aux pannes à au moins une décennie. Mais les industries qui en bénéficieront en premier — découverte de médicaments, science des matériaux, optimisation financière et cryptographie — devraient suivre ces jalons de près. L’écart entre « curiosité de laboratoire » et « préoccupation de planification stratégique » vient de se réduire considérablement.

Questions Fréquemment Posées

Qu’a réellement accompli la puce quantique Willow de Google ?

Willow est un processeur quantique supraconducteur à 105 qubits qui a démontré pour la première fois une correction d’erreurs quantiques sous le seuil. À mesure que les tableaux de code de surface passaient de grilles 3×3 à 5×5 puis 7×7, le taux d’erreur était réduit de moitié à chaque étape — prouvant que l’ajout de qubits rend le système plus fiable, et non moins. Il a aussi complété un calcul de référence en moins de 5 minutes qui prendrait 10 septillions d’années au supercalculateur le plus rapide.

L’informatique quantique est-elle prête pour les applications commerciales pratiques ?

Pas encore. Le benchmark de Willow (Random Circuit Sampling) ne résout aucun problème réel. Bien que Google ait démontré un avantage quantique en optimisation de portefeuille en octobre 2025, les ordinateurs quantiques tolérants aux pannes capables d’applications commerciales générales nécessiteront probablement des millions de qubits physiques. La plupart des experts estiment que cela prendra au moins une décennie. Les industries qui en bénéficieront en premier sont la découverte de médicaments, la science des matériaux et l’optimisation financière.

Comment Willow se compare-t-il aux efforts quantiques d’IBM ?

Le Willow de Google (105 qubits) s’est concentré sur la qualité de la correction d’erreurs, devenant le premier à démontrer des performances sous le seuil. IBM poursuit l’échelle, avec des processeurs Condor à 433 qubits déployés et un objectif d’avantage quantique vérifié d’ici fin 2026 avec son Nighthawk à 120 qubits. Microsoft adopte une troisième approche avec les qubits topologiques. Les trois font face au même défi : passer de centaines à des millions de qubits pour la tolérance aux pannes.

Sources et lectures complémentaires

- Meet Willow, Our State-of-the-Art Quantum Chip — Google Blog

- Quantum Error Correction Below the Surface Code Threshold — Nature

- Making Quantum Error Correction Work — Google Research

- Google Debuts New Quantum Chip and Roadmap Details — HPCwire

- Google Opens Early Access to Willow Quantum Processor — The Quantum Insider