جدار الذاكرة الذي تخترقه HBM4

كل نموذج ذكاء اصطناعي — من GPT-5.4 إلى Gemini 3.1 — يصطدم بنفس عنق الزجاجة: يمكن لـ GPU الحساب أسرع مما يمكن للذاكرة تغذيته بالبيانات. “جدار الذاكرة” هذا يعني أن المعالجات تبقى خاملة في انتظار الدفعة التالية من الأوزان والتنشيطات. في فبراير 2026، بدأت Samsung شحن أول HBM4 تجارية في الصناعة، محققة قفزة جيلية في عرض النطاق الترددي.

مبنية على عملية DRAM الجيل السادس 10 نانومتر (1c) من Samsung، تحقق HBM4 سرعات نقل ثابتة تبلغ 11.7 جيجابت/ثانية لكل دبوس، مع إمكانية تصل إلى 13 جيجابت/ثانية. مع 2,048 دبوس إدخال/إخراج بيانات — ضعف 1,024 في HBM3E — تقدم مجموعة HBM4 واحدة حتى 3.3 تيرابايت/ثانية من عرض النطاق الترددي، تحسن بمقدار 2.7 ضعف.

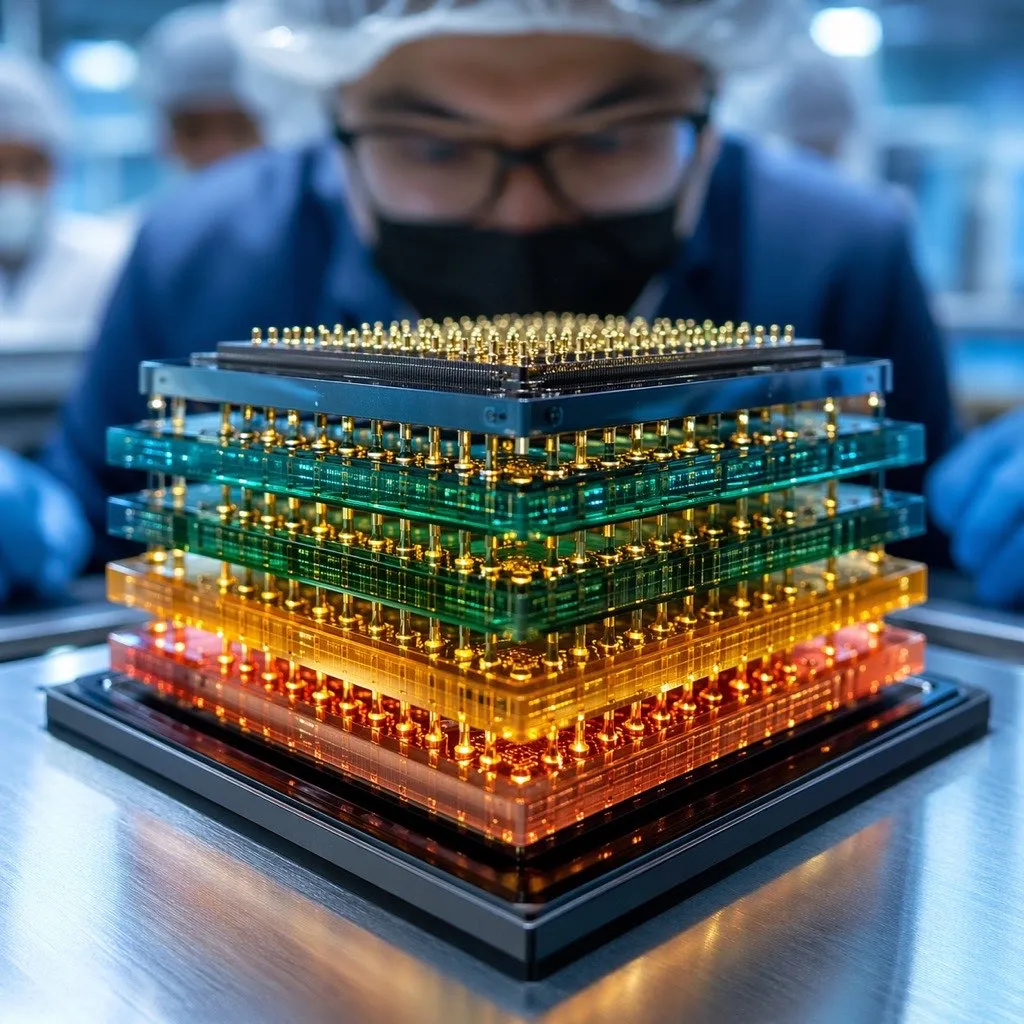

تكديس أعلى: من 36 إلى 48 جيجابايت

تستخدم مجموعة HBM4 الحالية من Samsung تقنية تكديس 12 طبقة، بسعات من 24 إلى 36 جيجابايت. لكن الهدف الحقيقي هو تكديس 16 طبقة الذي سيدفع السعة إلى 48 جيجابايت. للسياق، يستخدم GPU الحالي NVIDIA Blackwell B200 مجموعات HBM3E بسعة 24 جيجابايت لكل منها. مضاعفة ذلك إلى 48 جيجابايت يعني أن نماذج الذكاء الاصطناعي الأكبر يمكن أن تتسع بالكامل في ذاكرة GPU.

التحدي الهندسي هائل. يجب ترقيق كل قالب DRAM إلى حوالي 30 ميكرومتر قبل التكديس — أرق من شعرة بشرية — مع آلاف الفتحات العابرة للسيليكون (TSV) التي تربط الطبقات عمودياً. تبلغ عوائد DRAM 1c من Samsung حوالي 60%.

إعلان

مكاسب كفاءة تتجاوز السرعة الخام

تحقق HBM4 تحسناً بنسبة 40% في كفاءة الطاقة مقارنة بـ HBM3E عبر تقنية TSV منخفضة الجهد وتحسين شبكة توزيع الطاقة. تتحسن المقاومة الحرارية بنسبة 10% وتبديد الحرارة بنسبة 30%.

السباق الثلاثي على طلبيات NVIDIA

HBM4 هو الميدان الذي تتنافس فيه Samsung وSK Hynix وMicron بأشد حدة، لأن NVIDIA هي فعلياً العميل الوحيد المهم على نطاق واسع. تمتلك SK Hynix حالياً حوالي 70% من تخصيص HBM4 لدى NVIDIA لمنصة Vera Rubin القادمة، بينما تستحوذ Samsung على نحو 30%.

Samsung تقاتل بقوة لتقليص الفجوة. اجتازت الشركة اختبارات جودة NVIDIA، وبدأت الإنتاج الضخم في حرمها في Pyeongtaek، وتتوقع أن تتضاعف مبيعات HBM ثلاث مرات في 2026. تعاونت Samsung أيضاً مع AMD على حلول ذاكرة الذكاء الاصطناعي من الجيل القادم.

Samsung تستعرض بالفعل الجيل التالي. في NVIDIA GTC 2026، قدمت الشركة HBM4E، التي تقدم 16 جيجابت/ثانية لكل دبوس و4.0 تيرابايت/ثانية من عرض النطاق الترددي.

لماذا تهم HBM4 للبنية التحتية للذكاء الاصطناعي

يشهد سوق HBM ما يسميه المحللون “دورة فائقة لذاكرة الذكاء الاصطناعي”. تتوقع SK Hynix نمو HBM بنسبة 30% سنوياً حتى 2030، وسعة HBM الكاملة لدى Micron مباعة بالكامل حتى 2026.

بالنسبة للمؤسسات التي تبني أو تشتري بنية تحتية للذكاء الاصطناعي، لـ HBM4 تداعيات فورية. عمليات التدريب التي كانت تتطلب سابقاً إعدادات متعددة العقد لأن أوزان النموذج تجاوزت ذاكرة GPU واحدة قد تتسع على عدد أقل من وحدات GPU مع مجموعات HBM4 بسعة 48 جيجابايت.

الأسئلة الشائعة

ما هي HBM4 ولماذا تهم للذكاء الاصطناعي؟

HBM4 (ذاكرة عالية النطاق الترددي الجيل الرابع) هي أحدث تقنية ذاكرة مصممة خصيصاً لمسرعات الذكاء الاصطناعي. تقدم HBM4 من Samsung حتى 3.3 تيرابايت/ثانية من عرض النطاق الترددي — 2.7 ضعف أسرع من HBM3E — بسعات تصل إلى 48 جيجابايت عبر تكديس 16 طبقة. هذا مهم لأن نماذج الذكاء الاصطناعي محدودة بشكل متزايد بعرض النطاق الترددي للذاكرة.

كيف تقارن HBM4 من Samsung بعرض SK Hynix؟

شحنت Samsung أول HBM4 تجارية في العالم في فبراير 2026. لكن SK Hynix تمتلك حوالي 70% من تخصيص HBM4 لدى NVIDIA لمنصة Vera Rubin مقابل 30% لـ Samsung. كلتا الشركتين تتسابقان لتسليم تكوينات 16 طبقة.

متى سيتوفر عتاد الذكاء الاصطناعي المدعوم بـ HBM4 في السحابة؟

من المتوقع إطلاق منصة NVIDIA Vera Rubin التي تستخدم ذاكرة HBM4 في النصف الثاني من 2026. يحتاج مزودو السحابة عادة 3-6 أشهر بعد إطلاق GPU للنشر على نطاق واسع، مما يعني أن خوادم السحابة المبنية على HBM4 يجب أن تتوفر مطلع إلى منتصف 2027.