Le cloud qui fonctionne sans le cloud

Les bases militaires, les plateformes énergétiques offshore et les zones d’intervention d’urgence partagent un problème d’infrastructure commun : ils ont besoin de calcul de classe entreprise et d’IA, mais ne peuvent pas se connecter au cloud public. Des liaisons satellite intermittentes, des environnements radio contestés et des mandats stricts de souveraineté des données rendent les déploiements cloud traditionnels impossibles.

Le 31 mars 2026, Microsoft et Armada ont annoncé une collaboration répondant directement à cette lacune. Le partenariat apporte les capacités de Cloud Privé Souverain de Microsoft aux centres de données modulaires Galleon d’Armada, permettant aux clients d’exécuter des charges de travail sécurisées et conformes dans des environnements connectés de manière intermittente, contestés et totalement déconnectés. La solution est disponible dès maintenant, les deux entreprises engageant activement des déploiements clients.

Ce qu’Azure Local offre dans un conteneur maritime

Au cœur de cette collaboration se trouve Azure Local, la plateforme cloud sur site de Microsoft conçue pour les scénarios déconnectés et souverains. Azure Local fournit la même gouvernance, les mêmes contrôles de politiques et la même expérience de gestion qu’Azure public, mais tout s’exécute à l’intérieur du périmètre opérationnel du client sans aucune dépendance aux réseaux externes.

Le Cloud Privé Souverain de Microsoft, dévoilé en février 2026, unifie trois composants en une pile unique :

- Azure Local fournit la fondation d’infrastructure avec une gouvernance Azure cohérente, l’application des politiques et l’exécution des charges de travail, le tout fonctionnant dans l’environnement local lorsque les systèmes sont isolés des réseaux externes.

- Microsoft 365 Local exécute les charges de travail de productivité essentielles, incluant Exchange Server, SharePoint Server et Skype for Business Server, entièrement à l’intérieur du périmètre souverain.

- Foundry Local permet aux organisations d’exécuter des modèles d’IA multimodaux localement sur leur propre matériel en utilisant l’infrastructure de partenaires comme NVIDIA, avec l’inférence locale et des API fonctionnant entièrement dans les limites de données contrôlées par le client. Aucun trafic ne quitte l’environnement.

Les opérations déconnectées d’Azure Local sont désormais disponibles dans le monde entier. Foundry Local est accessible aux clients qualifiés nécessitant l’inférence IA de grands modèles dans des environnements air-gapped.

Armada Galleon : du calcul renforcé, de la valise au mégawatt

Armada, l’entreprise d’infrastructure en périphérie basée à San Francisco, fondée fin 2022 par Dan Wright (PDG) et Jon Runyan (COO), fournit la couche physique qui rend Azure Local déployable partout où il y a de l’électricité. La gamme Galleon couvre plusieurs formats : des unités de terrain de la taille d’une valise au Cruiser de 20 pieds, jusqu’aux centres de données à l’échelle du mégawatt.

Chaque Galleon arrive préchargé avec le calcul, le réseau, le stockage, le chauffage et le refroidissement, configurable avec des CPU, GPU et XPU pour répondre aux demandes spécifiques de charge de travail. Les unités sont conçues avec des extérieurs blindés, des capteurs environnementaux et des caméras intégrées pour résister aux températures extrêmes et aux menaces physiques.

Le Leviathan phare, annoncé parallèlement au tour de financement stratégique de 131 millions de dollars d’Armada en juillet 2025, est une puissance refroidie par liquide offrant 10 fois la capacité de calcul du modèle Triton précédent. Expédié dans deux conteneurs de 45 pieds plus un conteneur de 20 pieds, le Leviathan peut être colocalisé avec du gaz naturel inexploité, du solaire, du nucléaire ou d’autres sources d’énergie alternatives et devient opérationnel en semaines plutôt que les mois ou années nécessaires pour la construction traditionnelle de centres de données.

Ce tour de 131 M$ a attiré Founders Fund, Lux Capital, Shield Capital, M12 (le fonds de capital-risque de Microsoft) et Felicis, entre autres, portant le total levé par Armada à plus de 226 millions de dollars.

Publicité

Une connectivité qui plie sans rompre

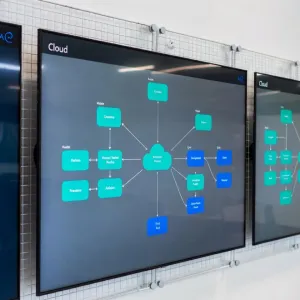

Ce qui distingue ce partenariat d’un déploiement standard sur site est la plateforme Edge d’Armada (AEP), la couche logicielle et de contrôle qui gère la connectivité, les charges de travail et les opérations de flotte à travers les unités Galleon distribuées.

AEP fournit un SD-WAN multi-réseau combinant Starlink satellite, 5G, LTE et liaisons RF pour maintenir une connectivité résiliente lorsqu’elle est disponible. Lorsque la connectivité est complètement perdue, Azure Local continue de fonctionner de manière autonome, la synchronisation ne s’effectuant que lorsque les liaisons reprennent. La plateforme Atlas d’Armada fournit un tableau de bord unifié pour surveiller les terminaux satellite, le SD-WAN, les drones, les réseaux 5G privés et les nœuds de calcul en périphérie.

Cette architecture signifie qu’un Galleon déployé sur un site énergétique distant peut traiter des charges de travail d’inférence IA, exécuter les outils de productivité Microsoft 365 et appliquer les politiques de gouvernance Azure, le tout en fonctionnant uniquement sur la connectivité satellite ou en mode totalement air-gapped.

Le marché gouvernemental s’accélère

Armada n’attend pas que la demande se matérialise. Le 7 avril 2026, l’entreprise a ouvert son premier Galleon Experience Center au siège de Carahsoft Technology à Reston, en Virginie, l’un des plus grands distributeurs informatiques du secteur public aux États-Unis. Les agences gouvernementales fédérales, étatiques et locales, ainsi que les organisations d’éducation et de santé, peuvent désormais parcourir un environnement Galleon pleinement opérationnel et tester des charges de travail d’IA souveraine en conditions réelles.

En ancrant ce centre au sein d’un grand hub de distribution informatique gouvernementale, Armada obtient un accès direct aux décideurs en matière d’approvisionnement qui ont besoin de capacités IA dans des lieux où la connectivité cloud traditionnelle est limitée ou indisponible.

Ce que cela signifie pour la stratégie d’infrastructure en périphérie

Le partenariat Microsoft-Armada signale un changement structurel dans la façon dont les organisations pensent l’infrastructure cloud. Plutôt que d’étendre la connectivité cloud vers la périphérie, ce modèle apporte la pile cloud complète là où la mission l’exige, la connectivité étant optionnelle.

Pour les organisations de défense et de renseignement, cela élimine le compromis historique entre sécurité opérationnelle et capacités de calcul modernes. Pour les opérateurs énergétiques gérant des puits, pipelines ou installations renouvelables distants, cela signifie de la maintenance prédictive et de l’analytique opérationnelle pilotées par l’IA sans construire d’infrastructure permanente de centre de données. Pour les équipes d’intervention en cas de catastrophe, cela fournit du calcul déployable qui arrive préconfiguré et opérationnel en quelques jours.

L’implication plus large est que le « edge computing » n’est plus un compromis. Avec la gouvernance Azure, la productivité Microsoft 365 et l’inférence IA Foundry Local fonctionnant toutes à l’intérieur d’un conteneur renforcé, l’écart entre les capacités en périphérie et celles du centre de données s’est effectivement comblé pour les charges de travail pouvant opérer dans l’enveloppe de calcul du Galleon.

Questions Fréquemment Posées

Qu’est-ce qu’Azure Local et en quoi diffère-t-il d’Azure standard ?

Azure Local est la plateforme cloud sur site de Microsoft qui fournit la même gouvernance, les mêmes contrôles de politiques et la même expérience de gestion qu’Azure public, mais s’exécute entièrement dans l’environnement du client. Contrairement à Azure standard, il ne nécessite aucune connexion internet pour fonctionner. La gestion, l’application des politiques et l’exécution des charges de travail restent dans le périmètre local, la synchronisation ne s’effectuant que lorsque la connectivité est disponible.

À quelle vitesse un centre de données modulaire Armada Galleon peut-il être déployé ?

Les centres de données modulaires Galleon d’Armada sont conçus pour un déploiement rapide, devenant opérationnels en semaines plutôt que les mois ou années nécessaires pour la construction traditionnelle. Chaque unité arrive préchargée avec le calcul, le réseau, le stockage, le chauffage et le refroidissement. Le plus grand modèle, le Leviathan, est livré dans deux conteneurs de 45 pieds plus un conteneur de 20 pieds et offre une capacité de calcul refroidie par liquide à l’échelle du mégawatt.

Les solutions d’IA souveraine en périphérie peuvent-elles exécuter de grands modèles de langage sans connectivité internet ?

Oui. Foundry Local de Microsoft, composant de la pile Cloud Privé Souverain, permet aux organisations d’exécuter des modèles d’IA multimodaux localement sur leur propre matériel en utilisant l’infrastructure NVIDIA. Toute l’inférence et les appels API fonctionnent entièrement dans les limites de données contrôlées par le client, sans qu’aucun trafic ne quitte l’environnement. Cette capacité est actuellement disponible pour les clients qualifiés nécessitant l’IA de grands modèles dans des environnements air-gapped ou classifiés.

Sources et lectures complémentaires

- Building Sovereign AI at the Edge: Microsoft and Armada Collaborate to Deliver Azure Local on Galleon Modular Datacenters — Microsoft Azure Blog

- Armada to Deliver Sovereign AI at the Edge with Microsoft Azure Local — PR Newswire

- Microsoft Sovereign Cloud Adds Governance, Productivity and Support for Large AI Models — Microsoft Official Blog

- Microsoft and Armada Bring Azure Local to Galleon Modular Data Centers — Data Center Dynamics

- Armada Announces $131M Strategic Funding Round — PR Newswire

- Armada and Carahsoft Open First Galleon Experience Center — GlobeNewswire