MoE

IA & Automatisation

GLM-5.1 : le premier modèle open source à dominer SWE-Bench Pro — sans NVIDIA

ALGERIATECH Editorial

avril 18, 2026

⚡ Points Clés GLM-5.1 de Z.ai, publié le 7 avril 2026, a obtenu 58,4 sur SWE-Bench Pro — devançant GPT-5.4...

IA & Automatisation

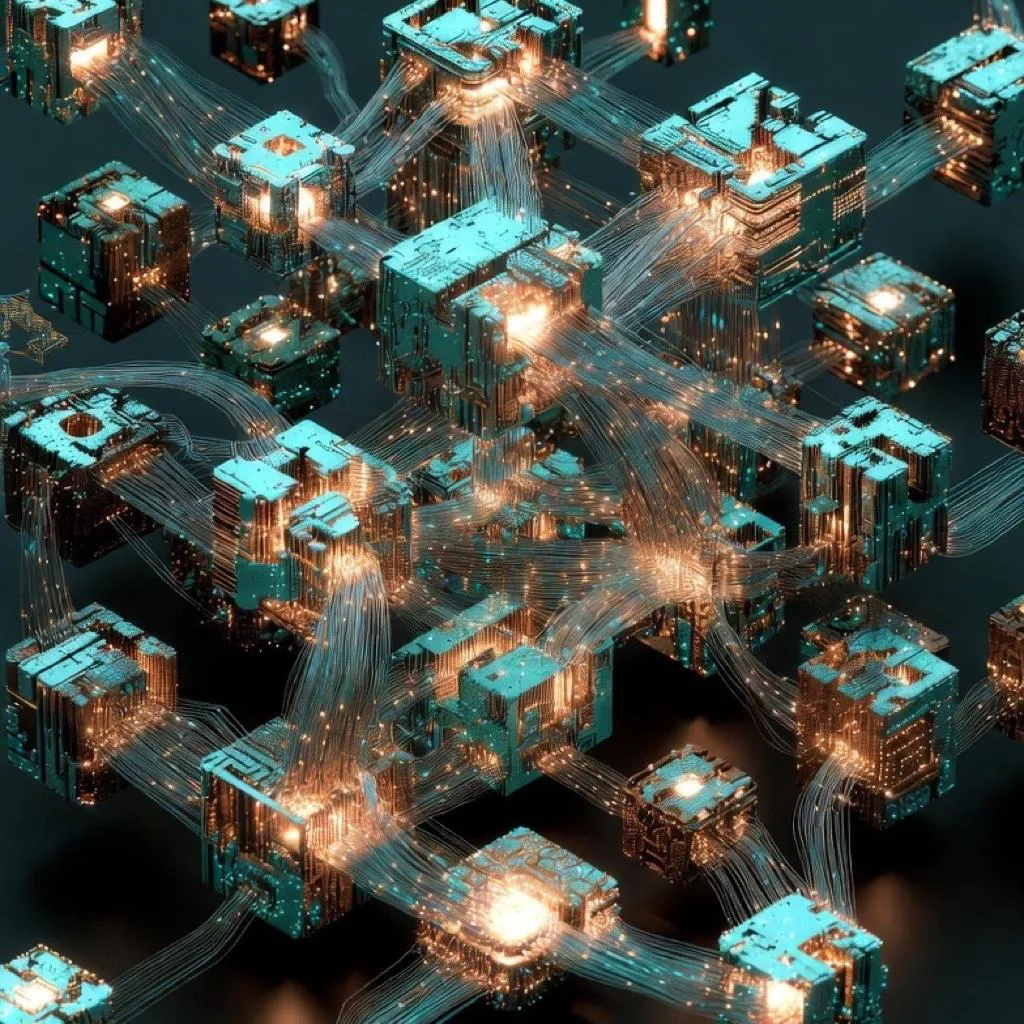

Mixture of Experts : Comment l’Architecture MoE Rend l’IA de Pointe Accessible

ALGERIATECH Editorial

février 27, 2026

GPT-4 compterait environ 1,8 trillion de paramètres. Pourtant, sur n'importe quel token — un mot, un signe de ponctuation — la grande majorité de ces paramètres reste totalement inactive.