De locataire de GPU niche à épine dorsale d’infrastructure

Pendant la majeure partie de la dernière décennie, « cloud » signifiait AWS, Azure et Google Cloud — trois hyperscalers possédant la pile de la fibre physique aux services managés. L’IA a changé le schéma. L’entraînement et l’exécution de modèles de frontière nécessitent des clusters GPU à une échelle que même les hyperscalers peinent à construire assez vite, et une nouvelle classe de fournisseur — le neocloud — a comblé le vide.

Les neoclouds sont des clouds GPU-natifs. Ils ne vendent pas des centaines de services ; ils vendent une capacité GPU NVIDIA (et de plus en plus custom) dédiée et à haute densité, souvent avec un réseau InfiniBand et un refroidissement conçu spécifiquement. CoreWeave, Lambda, Nebius, Crusoe, Core Scientific et Nscale forment le cœur de cette catégorie. Et en 2026, leur croissance n’est plus une histoire secondaire — c’est l’histoire principale.

Les accords qui ont recadré le marché

Trois transactions récentes définissent le changement :

CoreWeave + Meta, avril 2026. CoreWeave a annoncé le 9 avril 2026 un accord élargi selon lequel Meta paiera environ 21 milliards de dollars pour une capacité cloud IA dédiée jusqu’en décembre 2032. Combiné avec un arrangement précédent de 14,2 milliards, l’engagement total de Meta envers CoreWeave est d’environ 35 milliards — le plus grand contrat de calcul IA jamais signé. La nouvelle capacité inclura les premiers déploiements de la plateforme NVIDIA Vera Rubin, successeur de Blackwell, avec un focus sur les charges d’inférence.

Nebius + Meta. Nebius a sécurisé un accord séparé de 27 milliards avec Meta, avec environ 12 milliards engagés sur les cinq premières années. Nebius vise plus de 3 GW de puissance contractée fin 2026, ancré par un campus de 1 GW au Missouri et une usine IA de 310 MW en Finlande.

Microsoft à tous les niveaux. Microsoft s’est engagé à plus de 60 milliards sur des accords pluriannuels avec Nscale, Nebius, CoreWeave, Iren et Lambda — louant effectivement la capacité IA à des fournisseurs spécialisés plutôt que de tout construire en interne.

Ensemble, ces accords confirment que même les plus gros acheteurs d’IA du monde ne peuvent pas répondre à leurs besoins de calcul exclusivement via leur propre infrastructure.

L’économie qui fait fonctionner les neoclouds

Pourquoi un hyperscaler avec un capital infini loue-t-il chez CoreWeave au lieu de construire en interne ? Trois raisons :

Vitesse. Un neocloud peut ériger un cluster GPU en mois parce que toute son organisation d’ingénierie est construite autour de ce seul problème. Un hyperscaler construisant le même cluster à l’intérieur d’une région généraliste négocie à travers des dizaines de priorités concurrentes.

Flexibilité. Les engagements pluriannuels dédiés des hyperscalers aux neoclouds convertissent ce qui serait autrement du capex fixe pour l’hyperscaler en contrats de capacité structurés. Cela change le profil d’amortissement et permet à l’hyperscaler d’apparier l’offre à la demande plus finement.

Spécialisation. Les neoclouds sont construits pour la densité GPU, le réseau haute performance (InfiniBand ou tissus custom) et le refroidissement liquide dès le premier jour. Réaménager des régions cloud généralistes pour correspondre est coûteux et lent.

La trajectoire financière montre que le modèle fonctionne. CoreWeave a rapporté un revenu du T4 de 1,6 milliard, un revenu de l’exercice 2025 de 5,13 milliards, et un backlog de revenus qui a gonflé au-delà de 66 milliards — plus que quadruplant en glissement annuel. Les modèles d’analystes projettent environ 12,5 milliards de revenus 2026, soit environ quatre fois les ventes estimées de Nebius.

Publicité

Un marché de 236 milliards d’ici 2031

Mordor Intelligence évalue le marché du neocloud à 35,22 milliards en 2026, croissant à un TCAM de 46,37 % pour atteindre 236,53 milliards d’ici 2031. D’autres analystes projettent le marché à franchir 400 milliards d’ici 2031 à un TCAM de 58 %. Quelle que soit la prévision correcte, la catégorie est passée d’« émergente » à « structurellement importante » en une seule année.

Ce que cela signifie pour les acheteurs d’entreprise

Pour les entreprises en dehors du niveau hyperscaler, la montée du neocloud change le calcul d’achat de deux façons :

La capacité GPU tiers est désormais une vraie option. Les entreprises qui ont besoin d’entraînements pour des modèles spécifiques — pharma, services financiers, laboratoires IA nationaux — peuvent contracter directement avec un CoreWeave ou Lambda au lieu d’attendre dans une file AWS ou Azure. Pour les géographies sans régions GPU hyperscaler, c’est particulièrement significatif.

Le risque de concentration est réel. Quand Meta, Microsoft et Google détiennent tous des engagements de milliards de dollars chez les mêmes opérateurs neocloud, la capacité disponible pour les acheteurs plus petits se resserre. Les entreprises planifiant des charges IA 2026–2027 devraient verrouiller la capacité tôt et insister sur des clauses d’allocation garantie.

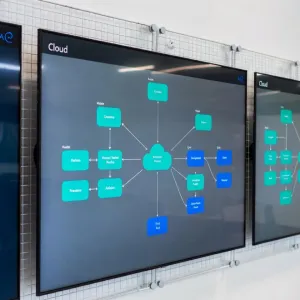

L’image macro : trois couches où il y en avait deux

L’infrastructure IA en 2026 se comprend mieux comme trois couches :

- Silicium. NVIDIA (plus AMD, Broadcom, Google TPU et le silicium custom émergent) construit les puces.

- Neocloud. CoreWeave, Lambda, Nebius, Nscale, Crusoe, Core Scientific opèrent le tissu GPU spécialisé.

- Hyperscaler ou entreprise. AWS, Azure, GCP, Meta et les grandes entreprises consomment la capacité — construite en interne ou louée depuis la couche 2.

La couche intermédiaire n’existait pas à grande échelle il y a trois ans. En 2026, elle absorbe des centaines de milliards de dollars en engagements pluriannuels. Pour quiconque réfléchit à où vont les dépenses IA, c’est le changement structurel à surveiller.

Questions Fréquemment Posées

Qu’est-ce exactement qu’un « neocloud » et en quoi est-il différent d’AWS ou Azure ?

Un neocloud est un fournisseur cloud construit spécifiquement pour livrer du calcul dense en GPU pour les charges IA. Contrairement aux hyperscalers — qui offrent des centaines de services à travers calcul, stockage, bases de données et logiciels managés — les neoclouds comme CoreWeave, Lambda et Nebius se concentrent sur une chose : des clusters GPU haute performance dédiés avec un réseau spécialisé (InfiniBand) et un refroidissement (souvent liquide). Cette spécialisation leur permet d’ériger la capacité IA plus vite et à plus haute densité qu’une région hyperscaler généraliste.

Pourquoi les hyperscalers louent-ils chez les neoclouds au lieu de construire en interne ?

Trois raisons : vitesse (les neoclouds déploient des clusters GPU plus vite parce que c’est leur seul travail), flexibilité (les contrats de capacité pluriannuels convertissent le capex fixe en engagements structurés plus flexibles), et spécialisation (l’architecture GPU-dense conçue spécifiquement est coûteuse à réaménager dans des régions cloud généralistes). Les plus de 60 milliards de dépenses neocloud de Microsoft, l’engagement CoreWeave de 35 milliards de Meta et l’accord Nebius de 27 milliards de Meta reflètent tous la même logique économique.

Comment les leaders IT d’entreprise devraient-ils évaluer les options neocloud en 2026 ?

Commencer par l’adéquation de charge : les neoclouds excellent à l’entraînement à grande échelle et à l’inférence haute densité mais ne sont pas optimisés pour la pile plus large de services cloud. Évaluer la présence géographique (les POPs neocloud se concentrent en Amérique du Nord et Europe de l’Ouest), les garanties SLA et d’allocation (la capacité est tendue quand les hyperscalers tiennent des engagements de milliards), et les coûts de sortie. Pour les feuilles de route IA pluriannuelles, exécuter une stratégie d’achat hybride — hyperscalers pour les charges générales plus allocation neocloud pour les pics d’entraînement — est souvent la meilleure adéquation.

Sources et lectures complémentaires

- CoreWeave et Meta annoncent un accord d’infrastructure IA élargi de 21 milliards — CoreWeave

- CoreWeave signe un accord d’infrastructure IA de 21 Md$ avec Meta Platforms — Quartz

- Rapport sur la taille et croissance du marché neocloud 2031 — Mordor Intelligence

- Recherche sur l’infrastructure neocloud — MLQ.ai

- Le pari de 60 Md$ de Microsoft dans le neocloud — Introl

- Boom infrastructure IA : revenus CoreWeave et Nebius — IndexBox

- CoreWeave vs Nebius : actions d’infrastructure IA — Global Market Pulse