لثلاث سنوات، كانت صناعة الذكاء الاصطناعي مهووسة بمقياس واحد: كم من الحوسبة يلزم لتدريب النموذج الحدودي التالي. يُقال إن تدريب GPT-4 كلّف أكثر من 100 مليون دولار. Gemini Ultra كلّف أكثر. كل جيل تطلّب عدداً أكبر بشكل أسّي من وحدات معالجة الرسومات، وطاقة أكثر، وأموالاً أكثر. المشروع البنائي الضخم للبنية التحتية — حيث تلتزم شركات الحوسبة الفائقة بما بين 600 و690 مليار دولار كنفقات رأسمالية لعام 2026 — كان مبرَّراً بافتراض أن التدريب سيستمر في التوسع.

باختصار: يمثّل الاستدلال في الذكاء الاصطناعي — عملية تشغيل النماذج المدرّبة لتوليد المخرجات — الآن ما يقارب ثلثي إجمالي حوسبة الذكاء الاصطناعي، ارتفاعاً من الثلث في 2023. يدفع هذا التحول جيلاً جديداً من عتاد الاستدلال المتخصص من شركات مثل Cerebras ويعيد تشكيل هياكل التكلفة، حيث ينخفض سعر الرمز الواحد بنحو 10 أضعاف سنوياً. اقتصاديات الاستدلال، وليس التدريب، هي التي ستحدد أي شركات الذكاء الاصطناعي ستبقى.

الانقلاب الكبير

تدريب نموذج لغوي كبير هو حدث. يحدث مرة واحدة — أو ربما عدة مرات مع صقل النموذج وتحديثه. يتطلب مجموعات ضخمة ومتزامنة بإحكام من وحدات معالجة الرسومات تعمل بتنسيق لأسابيع أو أشهر. إنه كثيف رأس المال، متطلب تقنياً، ومتركز بشكل متزايد بين عدد قليل من المؤسسات التي تمتلك الموارد لمحاولته.

الاستدلال هو عكس كل ذلك. يحدث باستمرار، في كل مرة يرسل فيها مستخدم رسالة إلى ChatGPT، وكل مرة يستدعي فيها تطبيق مؤسسي واجهة برمجة تطبيقات (API) للذكاء الاصطناعي، وكل مرة يولّد فيها مساعد برمجة اقتراحاً. يعمل الاستدلال 24 ساعة في اليوم، 7 أيام في الأسبوع، طوال فترة تشغيل النموذج في الإنتاج. ومع تسارع تبني الذكاء الاصطناعي، ينمو حجم الاستدلال بشكل أسّي.

الأرقام تروي القصة. في 2023، مثّل التدريب ما يقارب ثلثي إجمالي حوسبة الذكاء الاصطناعي والاستدلال الثلث. بحلول 2025، قدّرت Deloitte أن الانقسام كان متساوياً تقريباً. في 2026، من المتوقع أن يمثّل الاستدلال ما يقارب ثلثي إجمالي الحوسبة — انقلاب كامل في ثلاث سنوات فقط.

تصف توقعات Deloitte التكنولوجية لعام 2026 هذا التحول بصراحة: على الرغم من تباطؤ نمو التدريب المسبق، فإن متطلبات الحوسبة من توسيع ما بعد التدريب (الذي يستخدم ما يقارب 30 ضعف الحوسبة اللازمة لتدريب النموذج الأساسي الأصلي)، وتوسيع وقت الاختبار (نماذج الاستدلال التي تتطلب أكثر من 100 ضعف حوسبة الاستدلال البسيط)، وزيادة الاستخدام تعني أن العالم يحتاج على الأرجح إلى المزيد من مراكز البيانات، وليس أقل.

تتوقع مجموعة Futurum أن إيرادات الاستدلال ستتجاوز إيرادات التدريب في 2026. هذا ليس لأن التدريب يتقلص. التدريب لا يزال ينمو. بل لأن الطلب على الاستدلال ينفجر — مدفوعاً بمنتجات ذكاء اصطناعي تصل الآن إلى مئات الملايين من المستخدمين اليوميين.

اقتصاديات الرموز

اقتصاديات الاستدلال تختلف جوهرياً عن التدريب، وفهم هذا الاختلاف أمر بالغ الأهمية لأي شخص يبني أو يستثمر في الذكاء الاصطناعي.

التدريب تكلفة ثابتة. تنفق 100 مليون دولار (أو 500 مليون، أو مليار دولار) لإنتاج نموذج. بمجرد تدريب النموذج، تصبح تلك التكلفة غارقة. يصبح السؤال: بأي تكلفة يمكنك تشغيل النموذج لخدمة العملاء؟

الاستدلال تكلفة متغيرة. كل رمز يُولَّد يكلف كهرباء ووقت رقاقة وعرض نطاق ذاكرة. بالنسبة لنظام ذكاء اصطناعي في الإنتاج، يمكن أن يمثّل الاستدلال 80% إلى 90% من إجمالي تكلفة الحوسبة على مدى عمر النظام. التدريب هو النفقات الرأسمالية؛ الاستدلال هو النفقات التشغيلية. وكما يعلم أي مشغّل أعمال، التكاليف التشغيلية هي التي تحدد الربحية.

تنخفض تكلفة الرمز الواحد بمعدل ملحوظ. وفقاً لتحليل Andreessen Horowitz، تنخفض تكاليف الاستدلال لأداء مكافئ للنماذج بنحو 10 أضعاف سنوياً. أداء مكافئ لـGPT-4 الذي كلّف 20 دولاراً لكل مليون رمز في أواخر 2022 يكلّف الآن ما يقارب 0.40 دولار لكل مليون رمز. يتفاوت معدل الانخفاض بشكل كبير حسب معيار الأداء المحدد — من 9 أضعاف إلى ما يصل إلى 900 ضعف سنوياً لمستويات قدرة معينة — لكن الاتجاه العام لا لبس فيه.

هذا الانكماش هو الفرصة والتهديد معاً. بالنسبة لمستهلكي الذكاء الاصطناعي، انخفاض تكاليف الاستدلال يعني أن قدرات الذكاء الاصطناعي تصبح اقتصادياً قابلة للتطبيق لمجموعة أوسع من الاستخدامات. بالنسبة لمزوّدي الذكاء الاصطناعي، الانكماش ذاته يعني أن الإيرادات لكل استعلام تتقلص بلا هوادة، مما يتطلب نمواً هائلاً في الحجم للحفاظ على الإيرادات.

المنافسون في رقائق الاستدلال

فتح التحول نحو الاستدلال جبهة تنافسية لم تواجهها NVIDIA في حقبة هيمنة التدريب. يتطلب التدريب مجموعات ضخمة من وحدات معالجة الرسومات مع روابط بينية فائقة النطاق — القوة الأساسية لـNVIDIA. الاستدلال، بالمقابل، أكثر قابلية للتجزئة. يمكن معالجة الاستعلامات الفردية بشكل مستقل، مما يقلل الحاجة إلى مجموعات مترابطة بإحكام ويفتح الباب أمام بنى بديلة.

برزت شركتان كأبرز المنافسين: Cerebras وGroq.

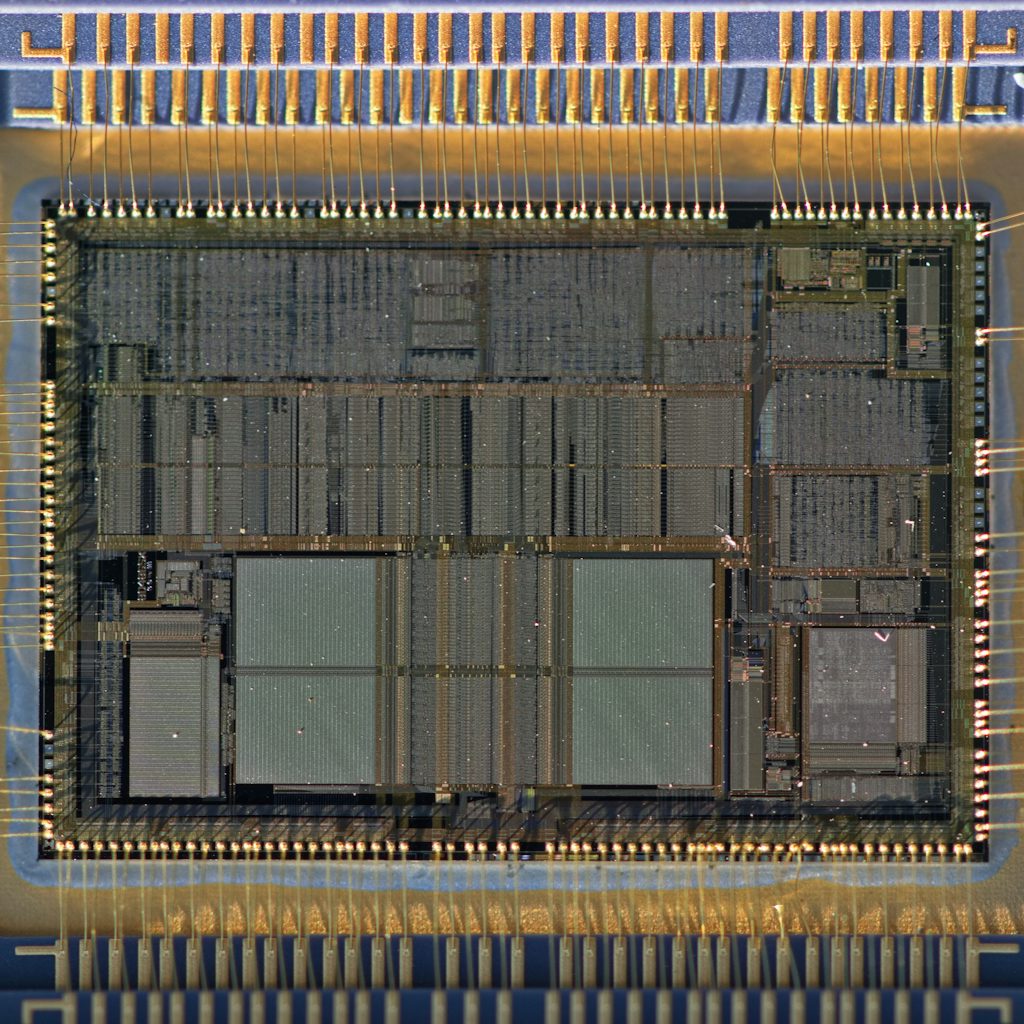

Cerebras اتخذت النهج الجريء ببناء أكبر رقاقة تم تصنيعها على الإطلاق. نظام CS-3، المدعوم بمحرك الرقاقة على مستوى الشريحة (wafer-scale engine)، يضع مسرّع ذكاء اصطناعي كاملاً على شريحة سيليكون واحدة بدلاً من تقطيعها إلى رقائق فردية. النتيجة نظام بعرض نطاق هائل لذاكرة SRAM على الرقاقة — حوالي 21 بيتابايت في الثانية — يلغي عنق زجاجة نقل البيانات الذي يحدّ من استدلال وحدات معالجة الرسومات التقليدية.

تُظهر المعايير المستقلة من Artificial Analysis ميزة الأداء. حققت Cerebras 2,100 رمز مخرج في الثانية على نماذج فئة 70B، وحوالي 2,500 رمز في الثانية على Llama 4 Maverick، مقارنة بنحو 1,000 رمز في الثانية على NVIDIA Blackwell لنفس النموذج. على نموذج gpt-oss-120B من OpenAI، تقدم Cerebras حوالي 2,700 رمز في الثانية. ميزة السرعة ليست تدريجية — إنها تحويلية للتطبيقات التي تتطلب استجابة في الوقت الحقيقي.

صادق السوق على نهج Cerebras في يناير 2026 عندما وقّعت OpenAI صفقة استدلال بقيمة 10 مليارات دولار مع الشركة. تغطي الاتفاقية حوالي 750 ميغاواط من قدرة الحوسبة، مع نشر الأنظمة الأولى خلال الربع الأول من 2026 والتوسع حتى 2028. بالنسبة لـOpenAI — التي يخدم ChatGPT الخاص بها أكثر من 900 مليون مستخدم نشط أسبوعياً — تؤثر تكلفة الاستدلال وسرعته مباشرة على جدوى نماذج أعمالها الاستهلاكية والمؤسسية.

Groq ابتكرت وحدة معالجة اللغة (LPU)، بنية رقاقة مصمّمة خصيصاً لتوليد الرموز المتسلسل الذي يميّز استدلال النماذج اللغوية الكبيرة. أظهرت خدمة Groq السحابية العامة سرعات استدلال ولّدت اهتماماً واسعاً في أوائل 2025، حيث قدمت نماذج مثل Llama وMixtral بسرعات جعلت خدمات وحدات معالجة الرسومات الحالية تبدو بطيئة.

لكن مسار Groq اتخذ منعطفاً دراماتيكياً عشية عيد الميلاد 2025، عندما استحوذت NVIDIA فعلياً على الأصول الرئيسية للشركة فيما وصفه مراقبو الصناعة بصفقة استحواذ على الكفاءات. الصفقة، التي قُدّرت بنحو 20 مليار دولار — ما يقارب ثلاثة أضعاف تقييم Groq الأخير البالغ 6.9 مليار دولار — أدخلت تقنية LPU من Groq تحت مظلة NVIDIA. انضم المؤسس والرئيس التنفيذي Jonathan Ross والرئيس Sunny Madra إلى NVIDIA، بينما تستمر Groq كشركة مستقلة اسمياً. صرّح Jensen Huang أن الخطة هي دمج معالجات Groq منخفضة زمن الاستجابة في بنية مصنع الذكاء الاصطناعي من NVIDIA. رسالة NVIDIA كانت واضحة: إذا بنيت رقاقة استدلال أفضل، سنستوعبك.

SambaNova، المنافس الثالث البارز، اتخذ نهجاً مختلفاً ببنية تدفق البيانات القابلة لإعادة التكوين (RDA). رغم توليد اهتمام إعلامي أقل من Cerebras أو Groq، بنت SambaNova نشاطاً مؤسسياً ذا معنى يركّز على أحمال العمل كثيفة الاستدلال. رقاقة الجيل الخامس SN50، المصمّمة خصيصاً للاستدلال الوكيلي والمقرر شحنها في النصف الثاني من 2026، توفر 5 أضعاف الحوسبة لكل مسرّع مقارنة بسابقتها. تستهدف SambaNova المؤسسات التي تتطلب نشر ذكاء اصطناعي خاص حيث تمنع متطلبات أمن البيانات الاستدلال السحابي.

إعلان

حدود الاستدلال الطرفي

لا يقتصر تحول الاستدلال على مراكز البيانات. فئة متنامية من أحمال عمل الذكاء الاصطناعي تنتقل إلى الطرف — تعمل على الأجهزة أو في خوادم محلية أو في منشآت إقليمية صغيرة بدلاً من بيئات السحابة الفائقة الحجم.

الدوافع مقنعة. التطبيقات الحساسة لزمن الاستجابة (الترجمة الفورية، المركبات ذاتية القيادة، التحكم الصناعي) لا تتحمل تأخير الرحلة ذهاباً وإياباً إلى مركز بيانات سحابي. التطبيقات الحساسة للخصوصية (الرعاية الصحية، الخدمات المالية، الحكومة) قد لا يُسمح لها بإرسال البيانات إلى خوادم خارجية. والتطبيقات الحساسة للتكلفة قد تجد أن عتاد الاستدلال المحلي، بمجرد شرائه، أرخص من رسوم واجهات برمجة التطبيقات السحابية المستمرة. حدّد تحليل Computerworld من معرض CES 2026 كفاءة التكلفة والمعالجة الطرفية وسيادة البيانات كالقوى الثلاث الأساسية التي تدفع المؤسسات نحو نشر الاستدلال داخل المقرّات.

منظومة عتاد الاستدلال الطرفي تتوسع بسرعة. منصة Jetson من NVIDIA، ومحرك الذكاء الاصطناعي من Qualcomm، وNeural Engine من Apple، ووحدات NPU في Meteor Lake من Intel جميعها تستهدف أحمال عمل الاستدلال على مستوى الأجهزة والطرف. تتضمن حواسيب Copilot+ PC من Microsoft وأجهزة مماثلة من مصنّعين آخرين وحدات معالجة عصبية مخصصة لتشغيل نماذج الذكاء الاصطناعي محلياً دون اتصال سحابي.

التداعيات عميقة. إذا انتقل الاستدلال بشكل متزايد إلى الطرف، فإن استثمارات مراكز البيانات الضخمة لشركات الحوسبة الفائقة قد لا تستحوذ على قدر كبير من سوق حوسبة الذكاء الاصطناعي كما توحي نفقاتها الرأسمالية. قد ينقسم سوق الحوسبة: تدريب مركزي في مصانع ذكاء اصطناعي ضخمة، واستدلال موزّع على الطرف.

كيف يعيد التحول تشكيل نماذج الأعمال

الانتقال من التدريب إلى الاستدلال ليس مجرد قصة عتاد. إنه يعيد تشكيل نماذج أعمال الذكاء الاصطناعي جذرياً.

بالنسبة لمزوّدي النماذج مثل OpenAI وAnthropic وGoogle، يعني التحول أن تكاليف التدريب تصبح تكلفة الدخول — نفقات البحث والتطوير اللازمة للحصول على منتج تنافسي — بينما تحدد تكاليف الاستدلال الربحية. نموذج أقل قدرة بقليل لكن أرخص بشكل كبير في التشغيل قد يولّد ربحاً أكثر من نموذج حدودي يكلّف ثروة لتقديمه. هذا يفسّر تركيز الصناعة المتزايد على تقطير النماذج والتكميم وتقنيات أخرى تستبدل تخفيضات متواضعة في القدرة بمكاسب كبيرة في كفاءة الاستدلال.

بالنسبة لمزوّدي السحابة، يعني التحول أن إيرادات الذكاء الاصطناعي تأتي بشكل متزايد من استدعاءات واجهة برمجة تطبيقات الاستدلال بدلاً من تأجير مجموعات التدريب. هذا يفضّل المزوّدين الذين يقدمون أقل تكلفة لكل رمز وأوسع توزيع. منصة Amazon Bedrock المحايدة تجاه النماذج، التي تتيح للعملاء الاختيار بين نماذج متعددة والدفع لكل استدلال، في وضع هيكلي أفضل لسوق يهيمن عليه الاستدلال من استراتيجية مرتبطة بعائلة نماذج واحدة.

بالنسبة للمؤسسات، يجعل التحول اقتصاديات الذكاء الاصطناعي أكثر قابلية للتنبؤ. كانت تكاليف التدريب متقطعة وغير متوقعة — يمكن لعملية تدريب فاشلة أن تهدر الملايين. تكاليف الاستدلال مستمرة ومتناسبة مع الاستخدام، مما يجعلها أسهل في الموازنة والتحسين والربط بنتائج الأعمال. هذه القابلية للتنبؤ تسرّع تبني المؤسسات للذكاء الاصطناعي.

بالنسبة للشركات الناشئة، انخفاض تكلفة الاستدلال هو المُعادِل الكبير. بناء نموذج حدودي يتطلب مليارات الدولارات لا تملكها سوى حفنة من المؤسسات. بناء تطبيق فوق واجهات برمجة تطبيقات الاستدلال يتطلب رأس مال متواضع نسبياً. منحنى انكماش تكلفة الاستدلال يعني أن التطبيقات التي لم تكن مجدية اقتصادياً العام الماضي قد تنجح هذا العام، والتطبيقات التي تنجح هذا العام ستكون أكثر ربحية بشكل كبير العام القادم.

تداعيات البنية التحتية

لتحول الاستدلال تداعيات ملموسة على تصميم مراكز البيانات والاستثمار في البنية التحتية.

تختلف أحمال عمل الاستدلال جوهرياً عن أحمال عمل التدريب في متطلباتها التحتية. يتطلب التدريب مجموعات ضخمة ومترابطة بإحكام من وحدات معالجة الرسومات مع روابط بينية فائقة انخفاض زمن الاستجابة. أحمال عمل الاستدلال أكثر توزيعاً، ويمكنها تحمّل زمن استجابة أعلى بين الرقائق، وتستفيد من نسب ذاكرة وعرض نطاق مختلفة.

الرقائق المحسّنة للاستدلال عموماً أرخص وأكثر كفاءة في استهلاك الطاقة من وحدات معالجة الرسومات عالية الأداء المطلوبة للتدريب. تقدّر Deloitte أن سوق الرقائق المحسّنة للاستدلال سيتجاوز 50 مليار دولار في 2026. يمكن نشر هذه الرقائق في منشآت أصغر وأكثر توزيعاً بدلاً من مصانع الذكاء الاصطناعي المركزية الضخمة المطلوبة للتدريب.

هذا لا يعني أن المشروع البنائي الضخم لمراكز البيانات مضلَّل. لكنه يعني أن تخصيص رأس المال داخل هذا المشروع يتحول. ما يقارب 75% من إجمالي النفقات الرأسمالية لشركات الحوسبة الفائقة في 2026 سيموّل بنية تحتية مرتبطة بالذكاء الاصطناعي، ممثلاً ما يقارب 450 مليار دولار في إنفاق خاص بالذكاء الاصطناعي. ستتدفق أموال أكثر نحو العتاد المحسّن للاستدلال وبنى النشر الموزّعة والبنية التحتية الطرفية. أموال أقل، نسبياً، ستذهب نحو مجموعات تدريب أكبر من أي وقت مضى — رغم أن التدريب سيظل كثيف رأس المال بشكل هائل بالقيمة المطلقة.

ما الذي يأتي بعد ذلك

عصر الاستدلال بدأ للتو. عدة اتجاهات ستضخّم التحول في السنوات القادمة.

نماذج الاستدلال — أنظمة مثل سلسلة o من OpenAI التي تستخدم التفكير الموسّع أثناء الاستدلال — تزيد بشكل كبير حوسبة الاستدلال لكل استعلام. تقدّر Deloitte أن توسيع وقت الاختبار يمكن أن يتطلب أكثر من 100 ضعف حوسبة استدعاء استدلال بسيط. مع تحوّل قدرات الاستدلال إلى معيار، سينمو الطلب على الاستدلال بشكل أسرع.

وكلاء الذكاء الاصطناعي — أنظمة مستقلة تتخذ إجراءات متعددة لإنجاز المهام — تضاعف حجم الاستدلال. قد يُجري وكيل ينجز مهمة معقدة عشرات أو مئات الاستدعاءات للنموذج، كل منها يتطلب استدلالاً. مع انتقال الوكلاء من العروض التجريبية إلى عمليات النشر الإنتاجية، سيدفعون الطلب على الاستدلال بطرق لا تفعلها تفاعلات روبوتات المحادثة البسيطة.

النماذج متعددة الوسائط — أنظمة تعالج وتولّد الصور والفيديو والصوت إلى جانب النص — تتطلب حوسبة استدلال أكبر بكثير لكل استعلام مقارنة بالنماذج النصية فقط. مع تحوّل القدرات متعددة الوسائط إلى المعيار الافتراضي، ستزداد كثافة الحوسبة لاستدعاء استدلال متوسط.

الشركات والمستثمرون الذين فهموا حقبة التدريب بنوا ثروات. الشركات والمستثمرون الذين يفهمون حقبة الاستدلال سيبنون الثروات التالية. التحول جارٍ. الاقتصاديات واضحة. والتداعيات — على تصميم العتاد واستراتيجية السحابة ونماذج الأعمال وهيكل التكلفة الأساسي للذكاء الاصطناعي — بدأت للتو في الظهور.

إعلان

🧭 رادار القرار (المنظور الجزائري)

| البُعد | التقييم |

|---|---|

| الصلة بالجزائر | عالية — انخفاض تكاليف الاستدلال يخفض مباشرة حاجز دخول الشركات والمؤسسات الجزائرية لنشر تطبيقات الذكاء الاصطناعي، بينما يقلل الاستدلال الطرفي الاعتماد على الاتصال السحابي الدولي |

| جاهزية البنية التحتية؟ | جزئية — تمتلك الجزائر بنية تحتية سحابية محدودة للتدريب، لكن أجهزة الاستدلال الطرفي (الهواتف الذكية، الحواسيب المحمولة المزوّدة بـNPU) منتشرة بالفعل على نطاق واسع؛ يمكن لخوادم الاستدلال المحلية العمل دون عرض نطاق دولي |

| توفر المهارات؟ | جزئي — يستطيع المطورون الجزائريون بناء تطبيقات على واجهات برمجة تطبيقات الاستدلال بمهارات البرمجة الحالية، لكن تحسين الاستدلال (التكميم، تقطير النماذج، الضبط الخاص بالعتاد) يتطلب تدريباً متخصصاً |

| الجدول الزمني للعمل | فوري — يجب على الشركات الناشئة والمؤسسات الجزائرية البناء على واجهات برمجة تطبيقات الاستدلال الآن، مستفيدةً من الانكماش السنوي في التكلفة لإطلاق تطبيقات ستصبح أكثر ربحية مع الوقت |

| أصحاب المصلحة الرئيسيون | الشركات التقنية الناشئة الجزائرية، مختبرات الذكاء الاصطناعي الجامعية، مشغّلو الاتصالات (للنشر الطرفي)، الخدمات الرقمية الحكومية، مزوّدو تكنولوجيا الرعاية الصحية والتعليم |

| نوع القرار | استراتيجي — يخلق منحنى تكلفة الاستدلال نافذة للمبادرين الأوائل لبناء تطبيقات وخدمات مدعومة بالذكاء الاصطناعي قبل تشبّع السوق |

باختصار: ثورة الاستدلال هي يمكن القول أهم اتجاه في الذكاء الاصطناعي بالنسبة للجزائر. انخفاض تكاليف الاستدلال يعني أن الشركات الجزائرية لا تحتاج إلى تدريب نماذجها الخاصة — يمكنها بناء تطبيقات قيّمة فوق النماذج الحالية بتكاليف تنخفض بشكل كبير كل عام. الاستدلال الطرفي يقلل أيضاً الاعتماد على عرض النطاق الدولي، وهو عنق زجاجة مستمر للتكنولوجيا الجزائرية. الوقت لبناء تطبيقات الذكاء الاصطناعي هو الآن؛ الانتظار لا يسمح إلا للمنافسين بتأسيس مزايا المبادر الأول.

المصادر والقراءات الإضافية

- Why AI’s Next Phase Will Likely Demand More Computational Power, Not Less — Deloitte

- Cerebras Inks Transformative $10 Billion Inference Deal With OpenAI — The Next Platform

- CES 2026: AI Compute Sees a Shift from Training to Inference — Computerworld

- LLM Inference Price Trends — Epoch AI

- LLMflation: LLM Inference Cost Is Going Down Fast — Andreessen Horowitz

- AI Inference vs Training Infrastructure: Why the Economics Diverge — Introl

- Cerebras CS-3 vs Groq LPU — Cerebras

- NVIDIA Buying AI Chip Startup Groq’s Assets for About $20 Billion — CNBC

إعلان