Table des matières

- Introduction : Le Logiciel Qui Agit

- Couche 1 : Modèles de Fondation — Le Moteur de Raisonnement

- Couche 2 : Frameworks d’Orchestration — Le Système Nerveux

- Couche 3 : Outils et Protocoles — Les Mains

- Couche 4 : Mémoire et Contexte — Le Classeur du Cerveau

- Couche 5 : Évaluation et Garde-Fous — Le Contrôle Qualité

- Couche 6 : Déploiement et Opérations — Fonctionner en Production

- Le Tout Assemblé : Une Architecture d’Agent Réelle

- La Pile Est Encore en Formation

- Radar de Décision

- Sources et lectures complémentaires

Introduction : Le Logiciel Qui Agit {#introduction}

Chaque grand paradigme informatique possède sa pile technologique canonique. Le web avait LAMP (Linux, Apache, MySQL, PHP). Le mobile avait les SDK natifs et les app stores. Le cloud-native avait Kubernetes, Docker et les microservices.

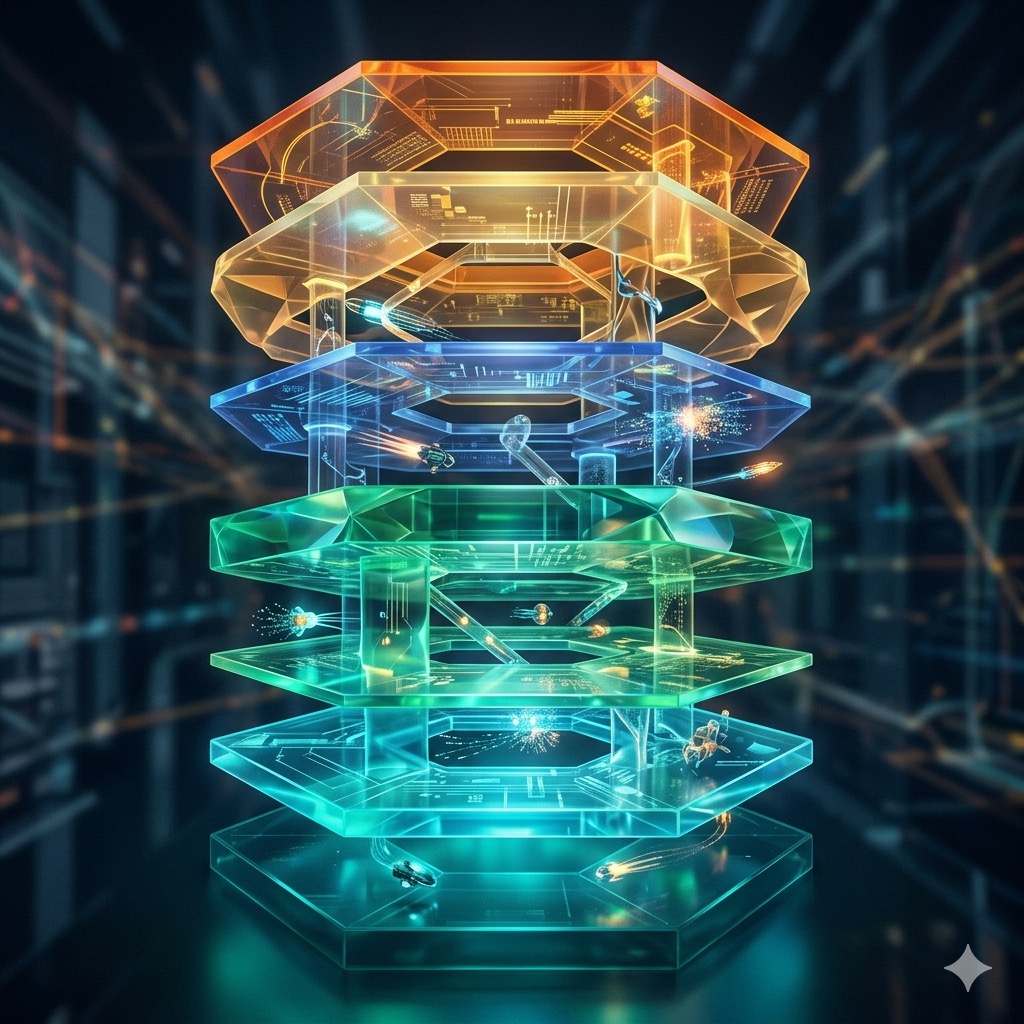

L’ère des agents IA assemble sa propre pile — un ensemble de technologies en couches qui, ensemble, permettent au logiciel de raisonner, planifier et agir de manière autonome. Comprendre cette pile est essentiel pour quiconque construit, évalue ou investit dans des systèmes alimentés par l’IA.

Ce guide décompose la pile IA agentique couche par couche, des modèles de fondation en bas jusqu’à l’outillage d’opérations en production en haut. Chaque couche représente un ensemble distinct de défis techniques et un ensemble distinct de fournisseurs en compétition pour la dominer. Ensemble, elles forment l’infrastructure qui alimente la révolution IA.

Couche 1 : Modèles de Fondation — Le Moteur de Raisonnement {#layer-1}

À la base de chaque agent IA se trouve un modèle de fondation. C’est le composant qui comprend le langage, raisonne sur les problèmes et génère des réponses. En 2026, le paysage comprend :

Modèles propriétaires de pointe : GPT-4o et o3 d’OpenAI, Claude Opus et Sonnet d’Anthropic, et Gemini 2.5 Pro de Google représentent l’état de l’art. Ces modèles excellent dans le raisonnement complexe, la compréhension de contextes longs et l’utilisation d’outils — les trois capacités les plus critiques pour les applications agentiques.

Alternatives open-source : La famille Llama 4 de Meta utilise une architecture Mixture-of-Experts — Maverick active 17 milliards de paramètres par jeton sur un total de 400 milliards, tandis que le modèle Behemoth en préversion approche les 2 billions de paramètres au total. Mistral Large et DeepSeek-V3 (671 milliards de paramètres au total, 37 milliards actifs) offrent des performances compétitives pour de nombreux cas d’usage. L’avantage de l’open-source n’est pas seulement le coût — c’est le contrôle. Les organisations peuvent affiner, déployer sur site et inspecter les poids du modèle.

Modèles spécialisés : Les modèles entraînés sur des données médicales, juridiques, financières ou scientifiques surpassent systématiquement les modèles généralistes dans leurs domaines, souvent à une fraction de la taille et du coût.

Choisir le Bon Modèle

L’erreur la plus courante dans l’architecture d’agents est la sur-spécification du modèle. Toutes les tâches d’un agent ne nécessitent pas un modèle de pointe. Un système bien architecturé route les tâches simples (classification, extraction, formatage) vers des modèles plus petits et moins coûteux et réserve les modèles de pointe pour les véritables défis de raisonnement.

Ce modèle de « routage de modèles » est devenu une pratique standard. Des entreprises comme Martian — qui utilise l’interprétabilité mécaniste pour cartographier les capacités des modèles — et Not Diamond — qui retourne des recommandations de routage en moins de 50 millisecondes — offrent une sélection automatisée de modèles. Not Diamond rapporte des améliorations de précision allant jusqu’à 25 % par rapport à n’importe quel modèle unique en routant chaque requête vers le fournisseur le mieux adapté. La plupart des systèmes en production utilisent cependant un routage heuristique plus simple basé sur le type et la complexité de la tâche.

Couche 2 : Frameworks d’Orchestration — Le Système Nerveux {#layer-2}

Un modèle de fondation seul est un cerveau dans un bocal. Les frameworks d’orchestration lui donnent un corps — connectant le modèle aux outils, gérant le flux de conversation, traitant les erreurs et coordonnant les tâches en plusieurs étapes.

Le Paysage des Frameworks

LangChain / LangGraph reste le framework le plus largement adopté, avec plus de 128 000 étoiles GitHub début 2026. LangGraph, sa couche d’orchestration basée sur les graphes, modélise les tâches d’agents sous forme de graphes dirigés où les nœuds représentent des agents ou des points de décision et les arêtes contrôlent le flux de données — supportant le branchement conditionnel, l’exécution parallèle et l’état persistant. Des entreprises comme Klarna, Replit et Elastic utilisent LangGraph pour leurs systèmes d’agents en production.

CrewAI a popularisé la métaphore de l’« équipage » — des équipes d’agents spécialisés avec des rôles définis collaborant sur des tâches complexes. Il fonctionne sur une architecture duale : les Crews gèrent la collaboration multi-agents autonome, tandis que les Flows fournissent une orchestration de workflows événementielle pour les environnements d’entreprise. CrewAI supporte désormais le protocole A2A de Google pour l’interopérabilité des agents et a développé une communauté certifiée de plus de 100 000 développeurs.

Microsoft Agent Framework est le successeur d’AutoGen et Semantic Kernel, unifiant les deux en une seule plateforme de production. Le framework a atteint le statut de Release Candidate début 2026, visant une version 1.0 GA d’ici fin Q1 2026 avec des API stables et versionnées et une certification de préparation entreprise. AutoGen lui-même reste maintenu pour les corrections de bugs critiques mais ne reçoit plus de nouvelles fonctionnalités significatives.

Claude Agent SDK d’Anthropic (renommé depuis le Claude Code SDK) fournit des abstractions légères sur les capacités natives d’utilisation d’outils et de réflexion étendue de Claude. Le SDK alimente Claude Code lui-même et est disponible en Python et TypeScript. Sa philosophie : le modèle devrait faire l’orchestration, pas le framework.

Le Paradoxe de l’Orchestration

Une orchestration plus sophistiquée ne produit pas toujours de meilleurs résultats. La recherche a montré de manière constante que l’ajout d’agents supplémentaires augmente les surcoûts de coordination et la propagation d’erreurs. Les meilleures architectures d’agents utilisent l’orchestration la plus simple qui atteint l’objectif.

Un seul agent avec de bons outils et des instructions claires surpasse un système multi-agents pour la grande majorité des tâches réelles. Les architectures multi-agents devraient être réservées aux charges de travail véritablement parallèles — comme la recherche simultanée dans plusieurs sources de données ou le traitement de documents dans différentes langues.

Couche 3 : Outils et Protocoles — Les Mains {#layer-3}

Les agents ne sont utiles qu’en fonction des outils auxquels ils ont accès. En 2026, deux approches dominent la manière dont les agents interagissent avec les systèmes externes.

Le Model Context Protocol (MCP)

MCP s’est imposé comme le standard de facto pour la communication agent-outil. Introduit par Anthropic fin 2024, MCP définit une interface universelle que tout fournisseur d’outils peut implémenter, permettant à tout agent compatible MCP de découvrir et d’utiliser l’outil automatiquement.

Pensez à MCP comme l’USB-C de l’IA. Avant l’USB, chaque périphérique nécessitait son propre connecteur et pilote. Avant MCP, chaque intégration agent-outil nécessitait du code personnalisé. MCP standardise la découverte d’outils (quels outils sont disponibles ?), la description d’outils (que fait cet outil et de quels paramètres a-t-il besoin ?) et l’invocation d’outils (comment l’appeler et récupérer les résultats ?).

En mars 2026, plus de 1 800 implémentations de serveurs MCP ont été cataloguées — couvrant les bases de données, les API, les systèmes de fichiers, les services cloud et les applications d’entreprise. Des plateformes majeures dont Cursor, Claude Code, Replit, Sourcegraph, Visual Studio Code et ChatGPT ont adopté MCP comme interface agent-outil principale.

Computer Use : La Solution GUI de Secours

Tout n’a pas d’API. Pour les systèmes legacy, les outils internes et les applications web qui manquent d’interfaces programmatiques, le computer use — des agents IA qui interagissent avec les interfaces graphiques — fournit une solution de secours puissante.

Les agents de computer use fonctionnent en prenant des captures d’écran, en identifiant les éléments d’interface et en simulant des clics de souris et des entrées clavier. Le computer use de Claude d’Anthropic, le CUA (Computer-Using Agent, désormais intégré à ChatGPT comme « mode agent ») d’OpenAI, et Project Mariner de Google — qui a obtenu 83,5 % sur le benchmark WebVoyager et peut exécuter 10 tâches en parallèle — représentent différentes approches de ce défi.

La technologie fonctionne bien pour les workflows structurés (remplir ce formulaire, naviguer vers cette page, cliquer sur ce bouton) mais reste fragile pour les tâches exploratoires nécessitant un jugement visuel. En pratique, le computer use est mieux déployé comme un pont — un moyen d’automatiser les processus legacy pendant que les API sont en cours de construction.

Publicité

Couche 4 : Mémoire et Contexte — Le Classeur du Cerveau {#layer-4}

Un agent qui oublie tout entre les conversations est limité à des tâches simples et ponctuelles. La mémoire persistante — la capacité de maintenir et de récupérer des informations à travers les sessions — est ce qui transforme un chatbot en un assistant compétent.

Types de Mémoire d’Agent

Mémoire à court terme (contexte de conversation) : L’historique de conversation en cours. Limité par la fenêtre de contexte du modèle (jusqu’à 1-2 millions de jetons pour les modèles de pointe en 2026, bien que les limites pratiques soient plus basses).

Mémoire de travail (brouillon) : Notes temporaires que l’agent crée pendant une tâche complexe — résultats intermédiaires, plans partiels, hypothèses en cours de test. Cela est généralement maintenu dans le prompt ou un magasin clé-valeur léger.

Mémoire à long terme (connaissances persistantes) : Faits, préférences et interactions passées stockés dans une base de données vectorielle ou une base de connaissances structurée. L’agent récupère les mémoires pertinentes au début de chaque conversation.

Mémoire épisodique (expérience) : Enregistrements d’exécutions de tâches passées — ce qui a fonctionné, ce qui a échoué, et pourquoi. Cela permet aux agents d’apprendre de l’expérience et d’éviter de répéter les mêmes erreurs.

Le Modèle RAG

La Génération Augmentée par la Récupération (RAG) reste l’approche dominante pour ancrer les réponses des agents dans des informations vérifiées. Le modèle est conceptuellement simple : avant de générer une réponse, l’agent recherche dans une base de connaissances les documents pertinents et les inclut dans son contexte.

En pratique, le RAG est d’une complexité trompeuse. La stratégie de découpage des documents, la sélection du modèle d’embeddings, le classement de la récupération et la gestion de la fenêtre de contexte ont tous un impact significatif sur la qualité. La meilleure pratique émergente est le « RAG agentique » — où l’agent décide activement quoi rechercher, évalue si les informations récupérées sont suffisantes et itère jusqu’à avoir suffisamment de contexte pour répondre avec confiance.

Couche 5 : Évaluation et Garde-Fous — Le Contrôle Qualité {#layer-5}

La différence entre une démo et un système de production, c’est l’évaluation. L’évaluation des LLM — le test systématique des résultats des agents par rapport aux résultats attendus — est devenue une discipline d’ingénierie à part entière.

Cadres d’Évaluation

Les systèmes d’agents en production maintiennent généralement des suites d’évaluation qui testent :

- La précision : L’agent donne-t-il des réponses correctes à des questions connues ?

- La cohérence : Donne-t-il la même réponse à la même question posée différemment ?

- La sécurité : Refuse-t-il les requêtes nuisibles et évite-t-il de générer du contenu toxique ?

- La justesse de l’utilisation des outils : Appelle-t-il les bons outils avec les bons paramètres ?

- La latence et le coût : Respecte-t-il les budgets de performance ?

Des outils comme Braintrust (qui a levé 80 millions de dollars en février 2026 pour une valorisation de 800 millions de dollars), RAGAS (qui a été pionnier de l’évaluation sans référence pour les pipelines RAG), et DeepEval (un framework open-source offrant plus de 50 métriques évaluées par LLM) ont standardisé ces modèles d’évaluation. Les organisations les plus matures exécutent des suites d’évaluation dans le cadre de leur pipeline CI/CD — chaque mise à jour de modèle, changement de prompt ou modification d’outil déclenche un test de régression complet.

Alignement et Sécurité

Au-delà de la justesse fonctionnelle, les agents doivent être alignés avec les intentions de leur opérateur. C’est particulièrement critique pour les agents ayant un impact dans le monde réel — ceux qui peuvent envoyer des emails, exécuter des transactions, modifier du code ou interagir avec les clients.

L’architecture de sécurité standard comprend :

- Garde-fous en entrée : Filtrer et valider les requêtes utilisateur avant qu’elles n’atteignent le modèle

- Garde-fous en sortie : Filtrer les réponses du modèle pour les violations de politique, les fuites de données personnelles ou le contenu nuisible

- Garde-fous d’action : Exiger l’approbation humaine pour les actions à forts enjeux (transactions financières, suppression de données, communications externes)

- Surveillance : Journaliser toutes les actions de l’agent et signaler les comportements anormaux pour revue humaine

Couche 6 : Déploiement et Opérations — Fonctionner en Production {#layer-6}

La couche finale de la pile couvre comment les agents fonctionnent dans les environnements de production.

Infrastructure d’Inférence

Faire tourner des modèles de fondation à grande échelle nécessite une infrastructure spécialisée. Le choix entre l’auto-hébergement (sur vos propres GPU), l’hébergement cloud (via des fournisseurs d’API comme OpenAI, Anthropic ou Google), ou des approches hybrides dépend du volume, des exigences de latence et de la sensibilité des données.

Pour la plupart des organisations, le déploiement via API est le choix pragmatique. Les fournisseurs d’API gèrent le service de modèles, la mise à l’échelle et les mises à jour. Le compromis est la dépendance au fournisseur et des coûts par requête potentiellement plus élevés à grande échelle.

Observabilité et Surveillance

Les systèmes d’agents sont intrinsèquement non déterministes — la même entrée peut produire des sorties différentes. Cela rend les approches de surveillance traditionnelles (vérifier si la réponse correspond au résultat attendu) insuffisantes.

La surveillance des agents en production se concentre sur :

- La journalisation des traces : Enregistrer chaque étape de la chaîne de raisonnement de l’agent, y compris les appels d’outils, les résultats intermédiaires et les points de décision

- La détection d’anomalies : Signaler les schémas inhabituels — appels d’outils inattendus, temps de réponse anormalement longs, erreurs répétées

- Le suivi des coûts : Surveiller l’utilisation de jetons et les coûts d’API par agent, par tâche et par utilisateur

- Les boucles de retour utilisateur : Capturer les signaux explicites (pouce vers le haut/bas) et implicites (complétion de tâche, taux de réessai) des utilisateurs

Des plateformes comme LangSmith (étroitement intégrée à l’écosystème LangChain, supportant les SDK Python, TypeScript, Go et Java), Arize (qui s’est étendue de la surveillance ML traditionnelle à l’observabilité LLM via sa bibliothèque open-source Phoenix), et Helicone (une plateforme open-source qui a traité plus de 2 milliards d’interactions LLM, récemment acquise par Mintlify) ont construit des outils d’observabilité spécialisés à cet effet.

Le Tout Assemblé : Une Architecture d’Agent Réelle {#putting-it-together}

Voici à quoi ressemble un système d’agents IA de niveau production en pratique, en utilisant un agent de support client comme exemple :

1. Arrivée de la requête : Un client demande « Pourquoi ai-je été facturé deux fois pour ma dernière commande ? »

2. Orchestration (LangGraph) : Le framework route la requête à travers un arbre de décision. Est-ce une question de facturation ? Faut-il rechercher la commande ? Faut-il escalader vers un humain ?

3. Récupération de la mémoire : L’agent consulte sa mémoire persistante. Ce client a-t-il déjà contacté le support ? Quel est son historique de compte ?

4. Utilisation d’outil (MCP) : L’agent appelle l’API de gestion des commandes pour consulter les transactions récentes du client. Il trouve deux débits pour la même commande.

5. Raisonnement (Claude/GPT-4o) : Le modèle analyse les données de transaction, identifie que le double débit était un délai d’attente de la passerelle de paiement qui a déclenché un réessai, et rédige une réponse.

6. Garde-fous : Le filtre de sortie vérifie la conformité de la réponse avec la politique, l’exposition de données personnelles et le ton. Le filtre d’action confirme que l’émission d’un remboursement ne dépasse pas le niveau d’autorisation de l’agent.

7. Réponse : Le client reçoit une explication claire et une confirmation que le double débit a été remboursé.

8. Surveillance : L’intégralité de l’interaction est journalisée — trace de raisonnement, appels d’outils, temps de réponse, nombre de jetons. Le système d’évaluation note la réponse par rapport à des benchmarks de qualité.

L’ensemble de cette séquence se complète généralement en 3 à 8 secondes — plus rapide que la plupart des agents humains, et disponible 24h/24, 7j/7.

La Pile Est Encore en Formation {#stack-forming}

La pile IA agentique en 2026 ressemble à la pile de développement web vers 2005 — les pièces fondamentales existent, mais les standards sont encore en cours d’établissement, les meilleures pratiques émergent encore, et les frameworks dominants d’aujourd’hui pourraient être les systèmes legacy de demain.

Plusieurs questions ouvertes façonneront l’évolution de la pile :

L’orchestration va-t-elle migrer dans le modèle ? À mesure que les modèles deviennent meilleurs en planification et utilisation d’outils de manière native, le besoin de frameworks d’orchestration externes pourrait diminuer. L’approche d’Anthropic — framework minimal, capacité maximale du modèle — suggère cette direction.

MCP deviendra-t-il le standard’universel ? MCP a un fort élan et une large adoption, mais le protocole A2A (Agent-to-Agent) de Google — désormais en version 0.3, open-source sous licence Apache 2.0 et gouverné par la Linux Foundation — représente une vision complémentaire axée sur la communication agent-à-agent plutôt que sur l’interaction agent-outil. Les deux protocoles pourraient finir par coexister plutôt que par se concurrencer, adressant différentes couches de l’écosystème d’agents.

Les agents auront-ils besoin de leurs propres systèmes d’exploitation ? La transition des agents individuels vers des systèmes d’agents coordonnés suggère un besoin de systèmes d’exploitation IA — des plateformes qui gèrent les cycles de vie des agents, l’allocation des ressources et la communication inter-agents. C’est la direction que prend la révolution IA.

Ce qui est clair, c’est que la pile se standardise, se robustifie et devient plus accessible. Construire un agent IA de production en 2026 ne nécessite plus une expertise approfondie en apprentissage automatique — cela nécessite de l’ingénierie système, de bonnes pratiques d’évaluation et une compréhension claire des couches à construire versus à acheter.

Questions Fréquemment Posées

Qu’est-ce que the agentic ai stack ?

Cet article couvre les aspects essentiels de ce sujet, en examinant les tendances actuelles, les acteurs clés et les implications pratiques pour les professionnels et les organisations en 2026.

Pourquoi the agentic ai stack est-il important ?

Ce sujet est important car il a un impact direct sur la façon dont les organisations planifient leur stratégie technologique, allouent leurs ressources et se positionnent dans un paysage en évolution rapide.

Quels sont les points clés à retenir de cet article ?

L’article analyse les mécanismes clés, les cadres de référence et les exemples concrets qui permettent de comprendre le fonctionnement de ce domaine, en s’appuyant sur des données actuelles et des études de cas.

Sources et lectures complémentaires

- LangChain Documentation and Architecture Guide — LangChain

- The Model Context Protocol Specification — Anthropic

- Building Effective Agents — Anthropic Research

- AutoGen: Enabling Next-Gen Multi-Agent Applications — Microsoft Research

- Retrieval-Augmented Generation for Knowledge-Intensive NLP Tasks — Lewis et al.

- A Survey on Large Language Model-Based Autonomous Agents — Wang et al.

- The Shift from Models to Compound AI Systems — Berkeley AI Research