وكلاء يعيدون كتابة أنفسهم

اتبع مسار تطوير الذكاء الاصطناعي نمطًا ثابتًا: يبني البشر النماذج ويختبرونها ويحددون نقاط الضعف ويبنون نسخًا أفضل. يتحسن ذكاء النظام، لكن فقط بوتيرة الجهد الهندسي البشري. كل تحسين يتطلب من الباحثين افتراض ما أخطأ وتصميم إصلاح وإعادة تدريب أو ضبط النموذج وتقييم النتائج. الحلقة محدودة بطبيعتها بالنطاق الترددي والبصيرة البشرية.

أظهر فريق بحثي في جامعة كاليفورنيا، سانتا باربرا شيئًا مختلفًا جوهريًا. ورقتهم البحثية “وكلاء التطور الجماعي: التحسين الذاتي المفتوح عبر مشاركة الخبرات” (arXiv:2602.04837)، المنشورة في فبراير 2026، تقدم إطار GEA — حيث يحسّن وكلاء الذكاء الاصطناعي أنفسهم بمشاركة خبراتهم في مجمع جماعي وتعديل شيفرتهم الخاصة بناءً على ما يتعلمونه بشكل جماعي. بقيادة Xin Eric Wang، أستاذ مساعد في علوم الحاسوب في UCSB الذي يدير أيضًا مركز الجامعة للتعلم الآلي المسؤول، أظهر الفريق أن GEA حسّن الأداء على SWE-bench Verified من خط أساس ابتدائي بنسبة 20.0% إلى 71.0% — مقارنة بـ 56.7% لأفضل أسلوب تطور ذاتي موجود.

النتيجة مهمة ليس فقط لرقمها المرجعي بل لما تعنيه حول المسار المستقبلي لتطوير وكلاء الذكاء الاصطناعي. يحقق GEA أداءً يطابق أو يقترب من أفضل أُطر الوكلاء المهندسة بشريًا، لكنه يفعل ذلك عبر التحسين الذاتي المستقل بدلًا من الهندسة اليدوية. إذا استطاع الوكلاء تحسين قدراتهم الخاصة دون تدخل بشري — وإذا تراكمت تلك التحسينات بمرور الوقت — فقد ينفصل معدل تقدم الذكاء الاصطناعي عن وتيرة البحث البشري.

بنية GEA: كيف يعمل

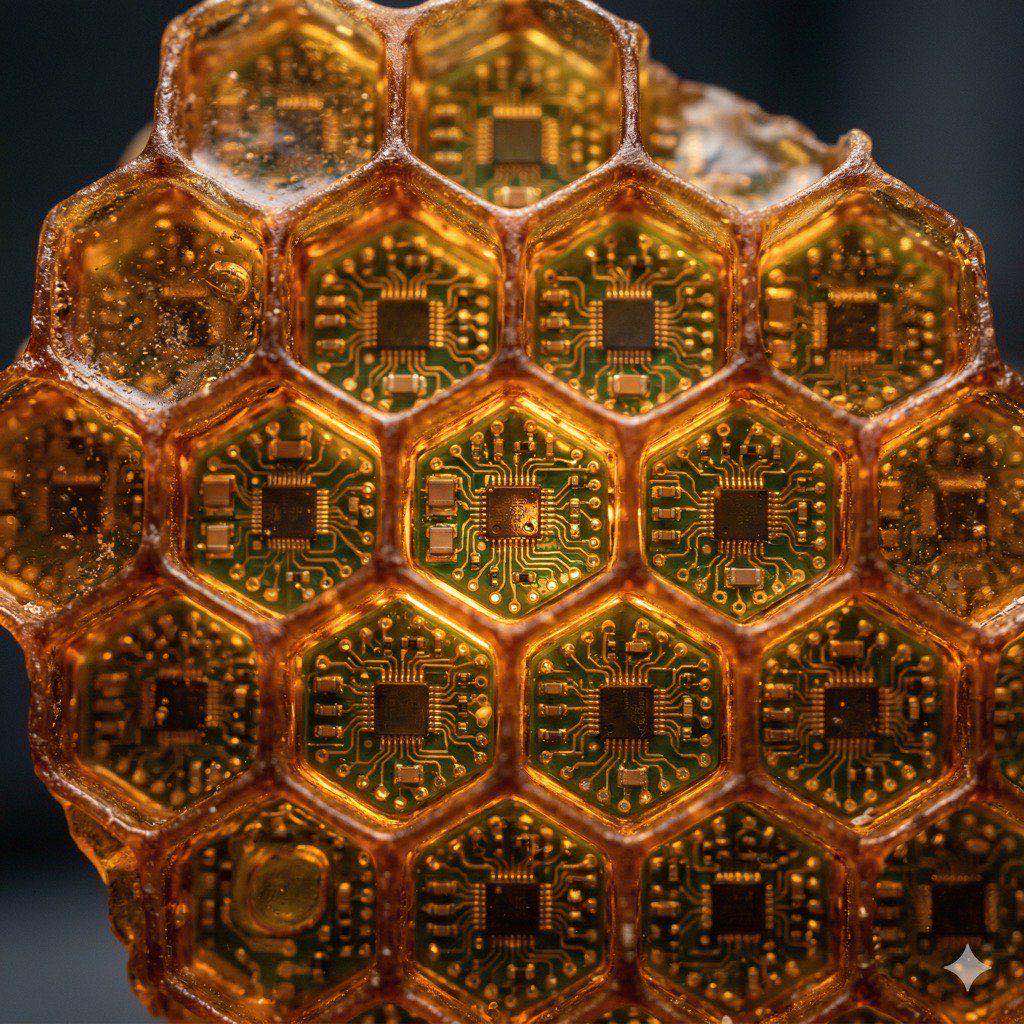

يرتكز إطار وكلاء التطور الجماعي على فكرة جوهرية تميزه عن مقاربات التطور الذاتي السابقة: وحدة التطور ليست وكيلًا واحدًا بل مجموعة. الأساليب السابقة مثل DGM (خط الأساس ذو البنية الشجرية) طوّرت الوكلاء بشكل مستقل على فروع معزولة، حيث أنتج كل وكيل ذرية دون مشاركة ما تعلمه مع وكلاء على فروع أخرى. يعامل GEA المجموعة كوحدة تطور أساسية، ممكنًا الوكلاء من تجميع خبراتهم والبناء على ابتكارات بعضهم البعض.

الآلية الأولى هي اختيار مجموعة الآباء. بدلًا من اختيار وكيل واحد عالي الأداء كأب للجيل التالي، يستخدم GEA تصنيف الأداء-الجِدّة الذي يوازن بين الكفاءة في المهام والتنوع التطوري. يضمن هذا أن النظام يستكشف عدة استراتيجيات واعدة في آن واحد بدلًا من التقارب المبكر على نهج واحد.

الآلية الثانية هي تجميع الخبرات. بينما يعمل الوكلاء على المهام — في هذه الحالة، حل مشكلات هندسة برمجيات حقيقية من مستودعات GitHub — يولدون آثارًا تطورية: رقع تعديل الشيفرة المطبقة على إطار الوكيل، ورقع المهام المتوقعة للمشكلات غير المحلولة، وسجلات التنفيذ بما في ذلك تاريخ استدعاء الأدوات، ونتائج التقييم الكاشفة عن أنماط الإخفاق. تُجمع كل الآثار من مجموعة الآباء في مجمع مشترك من الخبرة على مستوى المجموعة يمكن لكل وكيل الاستفادة منه.

الآلية الثالثة هي تطور المجموعة. يستخدم كل وكيل الخبرة المجمعة لتوليد توجيهات التطور — تعليمات مستنيرة حول كيفية تعديل شيفرته التشغيلية الخاصة. تنتج هذه التوجيهات رقعًا على مستوى الإطار تنشئ وكلاء ذرية. والأهم أن الوكلاء يحافظون على التباين حتى أثناء الاستفادة من الخبرة المشتركة، مما يضمن استمرار المجموعة في استكشاف استراتيجيات مختلفة.

يخلق المزيج حلقة تغذية راجعة: الوكلاء يحلون المهام، ويشاركون ما يتعلمونه، ويستخدمون المعرفة الجماعية لتحسين شيفرتهم الخاصة، والوكلاء المحسّنون يحلون المهام بفعالية أكبر. يصف الباحثون هذا بأنه حلقة “تحسين مفتوح” تعمل دون تدخل بشري.

نتائج SWE-bench: ماذا تعني الأرقام

أصبح SWE-bench Verified المعيار القياسي لتقييم قدرة وكلاء الذكاء الاصطناعي على التعامل مع مهام هندسة البرمجيات الحقيقية. أُطلقت النسخة المُتحقق منها (Verified) من OpenAI في أغسطس 2024، وتحتوي على 500 حالة اختبار منسقة مأخوذة من مستودعات GitHub حقيقية — أخطاء وطلبات ميزات فعلية قدمها مطورون حقيقيون. راجع كل عينة ثلاثة مصنفين منفصلين لضمان الجودة. يتطلب حل هذه المشكلات فهم قاعدة الشيفرة وتشخيص المشكلة وتنفيذ إصلاح والتأكد من اجتياز الإصلاح لمجموعة الاختبارات الحالية.

تمثل تحسينات GEA من 20.0% إلى 71.0% عبر 30 دورة من التطور الذاتي مكسبًا كبيرًا. للمقارنة، خط أساس DGM — الذي يستخدم تطورًا شجري البنية دون مشاركة الخبرات بين الفروع — احتاج 60 دورة ليصل إلى 56.7% فقط. GEA أكثر فعالية وكفاءة في آن واحد، محققًا نتائج أفضل في نصف عدد الدورات.

قُيّم النظام أيضًا على Polyglot، معيار برمجة متعدد اللغات، حيث تحسن من 38.2% إلى 88.3% في 20 دورة فقط، مقارنة بـ 68.3% لـ DGM في 40 دورة.

تضمن الإعداد التقني عدة نماذج لغوية تشغل وحدات مختلفة. تولى Claude Haiku 4.5 التنفيذ والتطور في أول 20-40 دورة، مع تولي Claude Sonnet 4.5 في الـ 10-20 دورة الأخيرة. وخدم GPT-o1 كوحدة التأمل طوال العملية.

اعتبار عملي مهم: عملية تطور GEA منفصلة عن النشر. بعد اكتمال التطور، يُنشر وكيل واحد متطور للاستدلال. هذا يعني أن تكلفة استدلال المؤسسة لا تتغير أساسًا مقارنة بإعداد وكيل واحد قياسي — عبء التطور تكلفة تدريب لمرة واحدة وليس نفقة تشغيلية مستمرة.

تجدر الإشارة إلى أنه حتى مطلع 2026، تسجل وكلاء البرمجة الرائدون المهندسون بشريًا — بما في ذلك الأنظمة المبنية على Claude 4.5 Opus وGemini 3 Pro — أكثر من 74% على SWE-bench Verified. أهمية GEA ليست في تجاوزه لكل الأنظمة الموجودة، بل في وصوله إلى مستوى الوكلاء المهندسين بشريًا من الطراز الأول عبر التحسين الذاتي المستقل وحده.

إعلان

الابتكارات التقنية

تميز عدة ابتكارات تقنية GEA عن المقاربات السابقة لوكلاء الذكاء الاصطناعي ذاتيي التحسين. الأهم هو صياغة “شيفرة الوكيل” كمنتج قابل للتعديل. في معظم أنظمة الذكاء الاصطناعي الوكيلية، يُحدد سلوك الوكيل بمزيج من النموذج اللغوي الأساسي وقوالب التعليمات الثابتة وإجراءات استدعاء الأدوات المبرمجة. يمكن للوكيل التعلم من خلال أمثلة السياق لكنه لا يستطيع تغيير منطقه التشغيلي الأساسي.

يعامل GEA الشيفرة التشغيلية للوكيل — تعليماته وأدواته واستدلالاته وخوارزميات تخطيطه — كبرنامج قابل للتعديل يستطيع الوكيل ذاته تعديله. هذا أكثر تعبيرية من التعلم في السياق لأنه يسمح بتغييرات هيكلية في عملية استدلال الوكيل. قد يضيف وكيل خطوة تصحيح أخطاء جديدة إلى سير عمله، أو يغير الترتيب الذي يستكشف به قاعدة شيفرة، أو يقدم استدلالًا جديدًا لتقرير متى يبحث عن حلول موجودة مقابل كتابة شيفرة جديدة.

الابتكار الثاني هو شكل تمثيل الخبرة. بدلًا من تخزين نصوص خام لتفاعلات الوكيل، يولد وكلاء GEA آثارًا تطورية منظمة تلتقط رقع تعديل الشيفرة وسجلات تنفيذ المهام بما في ذلك تاريخ استدعاء الأدوات ونتائج التقييم. يجعل هذا الشكل المنظم من الممكن للوكلاء استخلاص رؤى قابلة للتطبيق من مجمع الخبرة حتى مع نموه عبر دورات عديدة.

الابتكار الثالث هو متانة النظام. يصلح GEA الأخطاء الحرجة على مستوى الإطار في متوسط 1.4 دورة، مقارنة بـ 5 دورات لخط أساس DGM. يمنع هذا التصحيح الذاتي السريع تراكم الأخطاء الذي ابتلى مقاربات التطور الذاتي السابقة، حيث يمكن لتعديل سيئ واحد أن يتسلسل إلى تدهور الأداء عبر أجيال متتالية.

تداعيات على تطوير الذكاء الاصطناعي الوكيلي

لنتائج GEA تداعيات عملية فورية على تطوير وكلاء البرمجة بالذكاء الاصطناعي — الأنظمة التي تبنيها شركات مثل Anthropic وOpenAI وGoogle ومنظومة متنامية من الشركات الناشئة لمساعدة أو استبدال مهندسي البرمجيات البشريين.

تُحسن أنظمة البرمجة الوكيلية الحالية عبر التكرار الموجه بشريًا. يحلل الباحثون حالات الإخفاق ويفترضون تحسينات وينفذون التغييرات ويختبرون النتائج. هذه العملية فعالة لكنها بطيئة — كل دورة تكرار تستغرق أسابيع أو أشهرًا، والتحسينات محدودة بفهم الباحثين لسبب إخفاق النظام.

يقترح GEA مقاربة مكملة: نشر الوكلاء على أحجام كبيرة من المهام، وجمع خبراتهم، والسماح للوكلاء بتطوير استراتيجياتهم الخاصة بناءً على ما ينجح. يُظهر الإطار أن التحسينات تنبع من تحسينات سير العمل والأدوات بدلًا من التحسينات الخاصة بالنموذج، مما يعني أنها تنتقل بشكل متسق عبر نماذج أساسية مختلفة — وكلاء سلسلة GPT وسلسلة Claude يستفيدان من الاستراتيجيات المتطورة.

قابلية النقل هذه مهمة. تعني أن عملية التطور الذاتي ليست مقيدة بمزود نموذج معين. يمكن لمؤسسة تطوير وكلاء على نموذج أساسي واحد ونشر الاستراتيجيات الناتجة على آخر، أو تطوير استراتيجيات تظل فعالة مع ترقية النماذج الأساسية.

الفصل بين التطور والنشر مهم بالقدر ذاته لتبني المؤسسات. يمكن للشركات الحذرة من سلوك الذكاء الاصطناعي غير المتوقع تشغيل عملية التطور دون اتصال، وتقييم الوكيل الناتج بدقة، والنشر فقط بعد استيفاء متطلبات الجودة والأمان.

سؤال التحسين المفتوح

أكثر تداعيات GEA استفزازًا هو ما يوحي به حول التحسين المفتوح للذكاء الاصطناعي. لاحظ الباحثون أن GEA أظهر تحسنًا أسرع وأكثر وضوحًا في المراحل المتوسطة والمتأخرة من التطور، مما يشير إلى توحيد فعال لاتجاهات تطورية متنوعة بدلًا من عوائد متناقصة.

عمليًا، من المرجح أن عدة عوامل تحد من العملية. قدرة الوكلاء على التعديل الذاتي مقيدة بقدرات النموذج اللغوي الأساسي. لا يستطيع وكيل منح نفسه قدرات لا يدعمها النموذج الأساسي. مجمع الخبرة، رغم نموه، يمثل عينة محدودة من فضاء المشكلات وقد لا يحتوي على المعلومات اللازمة للتحسين إلى أجل غير مسمى.

الباحثون حذرون بشأن الاستقراء. يلاحظون أن سقف أداء النظام يُحدد في النهاية بقدرات النموذج الأساسي — سقف لا يمكن رفعه إلا بتحسينات على النموذج اللغوي الأساسي ذاته. يُظهر GEA أن فجوة كبيرة موجودة بين أداء النموذج الجاهز وما يمكن أن يستخرجه التطور الذاتي من نفس النموذج، لكن تلك الفجوة ليست لا نهائية.

مع ذلك، فإن إثبات أن الوكلاء يمكنهم تحسين قدراتهم الخاصة بشكل ذي معنى عبر مشاركة الخبرات الجماعية والتعديل الذاتي للشيفرة يعد معلمًا بارزًا. يشير إلى أن مستقبل تطوير وكلاء الذكاء الاصطناعي لن يشمل فقط باحثين بشريين يبنون أنظمة أفضل، بل الأنظمة ذاتها تشارك في تحسين نفسها. ديناميكيات حلقة التغذية الراجعة هذه — مدى سرعتها ومدى إمكاناتها وما هي الضوابط التي تتطلبها — ستكون سؤالًا محوريًا للمرحلة التالية من بحث الذكاء الاصطناعي.

اعتبارات الأمان والتحكم

يثير احتمال وكلاء الذكاء الاصطناعي ذاتيي التطور أسئلة طبيعية حول الأمان والتحكم. إذا كان الوكلاء يستطيعون تعديل شيفرتهم الخاصة، كيف نضمن أنهم يعدلونها في اتجاهات تظل متوائمة مع النوايا البشرية؟ ما الذي يمنع تعديلًا ذاتيًا من إدخال سلوكيات فعالة في المعيار المرجعي لكنها إشكالية في سياقات أخرى؟

يعالج GEA هذا عبر بنيته ذات المرحلتين. يحدث التطور دون اتصال، منتجًا وكيلًا نهائيًا يُقيَّم ثم يُنشر كنظام ثابت. خلال التطور، يُختبر كل تعديل مقابل مهام تقييم محتجزة، ولا تُحتفظ إلا بالتعديلات التي تنتج تحسنًا قابلًا للقياس. الوكيل المتطور، بمجرد نشره، لا يستمر في التعديل الذاتي — يعمل كنظام ثابت، تمامًا كأي وكيل ذكاء اصطناعي آخر.

لكن مع ازدياد قدرة الأنظمة ذاتية التطور ونشرها في بيئات أعلى مخاطر، تصبح كفاية معايير التقييم الثابتة موضع تساؤل. قد تحتوي المعايير ذاتها على ثغرات — أنماط إخفاق لم يتوقعها المصممون. وفي مجالات معقدة بما فيه الكفاية، قد تنتج التفاعلات بين تعديلات ذاتية متعددة سلوكيات ناشئة لم يكن أي تعديل فردي ليثيرها.

أخذ مجتمع أمان الذكاء الاصطناعي علمًا بـ GEA والأعمال المماثلة. يفحص مجموعة متنامية من الأبحاث حول الوكلاء ذاتيي التطور — بما في ذلك مسوحات شاملة تتتبع المجال — المخاطر الفريدة التي تطرحها أنظمة يتغير سلوكها بمرور الوقت بطرق قد لا تكون قابلة للتنبؤ بالكامل حتى لمبتكريها. تطوير أُطر أمان متينة لمثل هذه الأنظمة تحدٍ بحثي مفتوح سيصبح ملحًا بشكل متزايد مع نضوج قدرات التطور الذاتي.

الأسئلة الشائعة

ما المقصود بـ Self-Evolving AI Agents؟

يتناول هذا المقال الجوانب الأساسية لهذا الموضوع، ويستعرض الاتجاهات الحالية والجهات الفاعلة الرئيسية والتداعيات العملية على المهنيين والمؤسسات في عام 2026.

لماذا يُعد هذا الموضوع مهمًا؟

يكتسب هذا الموضوع أهمية كبيرة لأنه يؤثر بشكل مباشر على كيفية تخطيط المؤسسات لاستراتيجيتها التقنية وتخصيص مواردها وتموضعها في مشهد سريع التطور.

ما أبرز النقاط المستخلصة من هذا المقال؟

يحلل المقال الآليات الرئيسية والأطر المرجعية والأمثلة الواقعية التي تشرح كيفية عمل هذا المجال، مستندًا إلى بيانات حديثة ودراسات حالة عملية.

المصادر والقراءات الإضافية

- Group-Evolving Agents: Open-Ended Self-Improvement via Experience Sharing — arXiv (2602.04837)

- SWE-bench Verified Leaderboard — swebench.com

- New Agent Framework Matches Human-Engineered AI Systems — VentureBeat

- Awesome Self-Evolving Agents: Comprehensive Survey — GitHub (EvoAgentX)

- Xin Eric Wang — UC Santa Barbara Computer Science