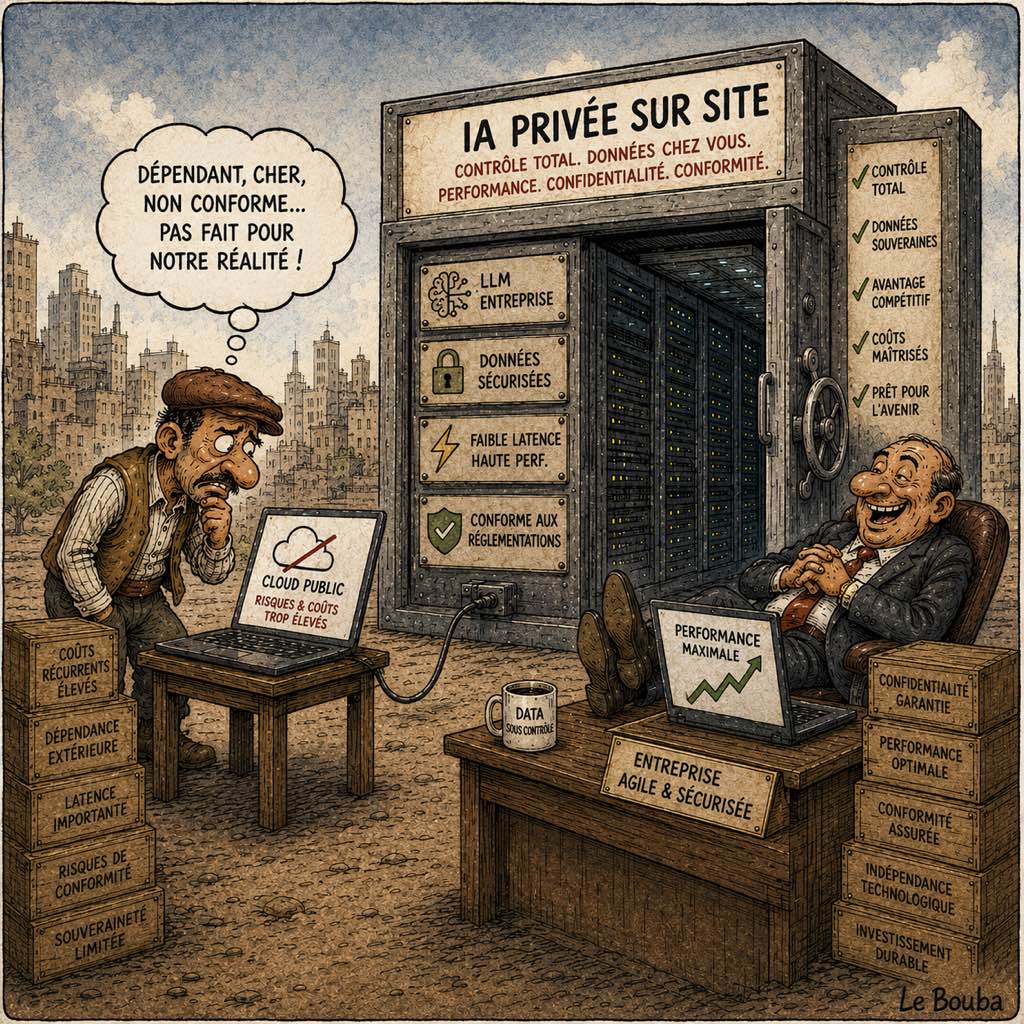

Deux Problèmes, Une Décision d’Infrastructure

Les entreprises algériennes qui adoptent des grands modèles de langage font face à deux pressions simultanées qui apparaissent rarement dans l’analyse technologique mondiale. La première est économique : les coûts des API cloud pour l’inférence LLM augmentent linéairement avec l’utilisation, et l’utilisation croît de manière non linéaire une fois que les équipes découvrent ce que les modèles peuvent faire. La seconde est juridique : le cadre de gouvernance des données d’Algérie — ancré par le décret présidentiel 25-320 du 30 décembre 2025 et l’amendement de juillet 2025 à la loi sur la protection des données personnelles (loi 11-25) — crée des obligations de conformité explicites pour les entreprises qui traitent des données sensibles via des fournisseurs cloud tiers.

Le déploiement d’un LLM sur site résout les deux problèmes en une seule décision d’infrastructure. Le calcul n’est pas théorique. Un serveur à 4 GPU NVIDIA H100 fonctionnant en continu coûte environ 200 $/mois en électricité sur site. La configuration cloud équivalente — quatre GPU H100 à la demande chez les principaux fournisseurs — coûte entre 5 840 $ et 13 140 $ par mois. Le coût matériel du serveur sur site est récupéré en 4 à 8 semaines de ce que vous auriez payé en frais de GPU cloud.

La nuance est l’utilisation. Les économies cloud favorisent les charges de travail irrégulières et imprévisibles ; les économies sur site favorisent les charges stables et prévisibles. Une entreprise exécutant l’inférence LLM 8 heures par jour, 5 jours par semaine, se situe en dessous du seuil de rentabilité. Une entreprise exécutant l’inférence en continu sur le support client, le traitement de documents et les outils d’analyse interne — la charge réaliste d’une banque ou d’une entreprise énergétique algérienne de taille moyenne — franchit le seuil de rentabilité dès le premier trimestre et accumule des économies chaque mois suivant.

Le Contexte de Gouvernance des Données en Algérie

La dimension juridique n’est pas optionnelle. Le décret présidentiel 25-320 du 30 décembre 2025 établit le cadre national de gouvernance des données de l’Algérie, créant des exigences formelles de classification, catalogage et interopérabilité sécurisée des données pour les administrations publiques. En complément, la loi 11-25 (l’amendement de juillet 2025 à la loi 18-07) a introduit des obligations de nomination de délégués à la protection des données, d’analyses d’impact, et une obligation de notification des violations sous 5 jours à l’ANPDP (Autorité Nationale de Protection des Données Personnelles).

L’implication pratique pour l’IA en entreprise : toute entreprise algérienne traitant des données citoyennes, des dossiers financiers ou des documents gouvernementaux via une API LLM hébergée dans le cloud transmet des données classifiées en dehors du périmètre de l’entreprise. Même si le centre de données du fournisseur cloud est situé en dehors de l’Algérie, le calcul d’inférence se produit sur une infrastructure que l’entreprise ne contrôle pas. Dans le cadre combiné du décret 25-320 et de la loi 11-25, cela crée une exposition à l’audit que les équipes juridiques sont encore en train d’analyser.

L’inférence sur site élimine entièrement cette exposition. Les poids du modèle résident sur du matériel appartenant à l’entreprise. Les invites, les complétions et les états intermédiaires ne quittent jamais le réseau d’entreprise. C’est l’architecture utilisée par les institutions financières à Singapour et les entreprises européennes soumises aux exigences de minimisation des données du RGPD.

Publicité

L’Avantage des Modèles Open Source

Le cas économique et de conformité pour l’inférence sur site est renforcé par la qualité des modèles open source disponibles en 2026. Les entreprises n’ont plus besoin d’API cloud propriétaires pour accéder à des modèles de langage de qualité production. Les séries Llama 3.3 de Meta, les modèles entreprise de Mistral et la famille Qwen 2.5 d’Alibaba fonctionnent tous efficacement sur un serveur à 4 GPU avec 96 à 384 Go de VRAM combiné, couvrent l’arabe comme langue de première classe et sont licenciés pour une utilisation commerciale sans frais par jeton.

Un serveur à 4 GPU NVIDIA RTX PRO 6000 Blackwell (384 Go de VRAM combiné) peut exécuter Llama 3.3 70B en précision complète — un modèle qui correspond aux performances GPT-4 pour la plupart des tâches d’entreprise — tout en servant 8 à 12 utilisateurs simultanés à une latence acceptable. C’est une capacité suffisante pour le déploiement IA interne d’une entreprise algérienne de taille moyenne : résumé de documents, rédaction d’e-mails, questions-réponses sur les politiques et assistance au code pour une équipe de 50 à 200 employés.

Le support de la langue arabe est particulièrement pertinent pour les entreprises algériennes. Qwen 2.5 72B se classe régulièrement parmi les meilleurs modèles open source pour les benchmarks de traitement du langage naturel arabe. L’exécuter sur site signifie que les entreprises algériennes peuvent créer des outils IA en langue arabe sans envoyer des documents arabes sensibles à des fournisseurs cloud américains ou européens.

Ce que les Responsables IT Algériens Devraient Faire

1. Effectuer un Référentiel de Coûts Cloud sur 30 Jours Avant l’Achat de Matériel

Avant de commander des serveurs GPU, mesurez ce que vous dépensez réellement en API d’inférence LLM aujourd’hui et projetez la croissance aux taux d’adoption actuels. Consolidez tous les dépenses en API LLM — OpenAI, Anthropic, Huawei Cloud ModelArts — en un seul chiffre mensuel. Si les dépenses mensuelles actuelles sont inférieures à 1 500 $ (environ 200 000 DZD aux taux actuels), le matériel sur site n’est pas encore rentable. Au-dessus de 3 000 $ par mois, le cas de seuil de rentabilité est convaincant. Au-dessus de 6 000 $ par mois, les économies sur un cycle de vie matériel de 4 ans sont substantielles.

2. Commencer par un Déploiement de Validation à GPU Unique

Le plus grand risque de mise en œuvre pour les entreprises algériennes n’est pas la défaillance du matériel — c’est l’échec d’adoption organisationnelle. Les équipes habituées aux API cloud s’attendent à des temps de réponse inférieurs à la seconde. L’inférence sur site sur un seul GPU exécutant un modèle 70B peut fournir 15 à 25 jetons par seconde par utilisateur — adéquat pour la plupart des tâches, mais perceptiblement plus lent que les API cloud. Validez l’acceptation des utilisateurs sur un pilote à GPU unique avant d’investir dans un cluster de production à 4 ou 8 GPU.

3. Traiter la Couche de Service d’Inférence Séparément du Matériel

Le matériel (serveur GPU) et le logiciel (service d’inférence) sont des décisions d’approvisionnement et de configuration distinctes. vLLM, TensorRT-LLM et Ollama sont les trois principaux frameworks de service d’inférence open source en 2026. vLLM est la norme en entreprise : il prend en charge le traitement par lots continu, gère efficacement la mémoire GPU sous charge simultanée et s’intègre avec le format d’API OpenAI — ce qui signifie que le code existant écrit contre les API cloud nécessite des modifications minimales pour pointer vers un point de terminaison vLLM local. Validez à l’avance que votre fournisseur de matériel certifie la compatibilité vLLM avant l’achat.

Où Cela S’Inscrit dans le Paysage IA de l’Algérie en 2026

Le déploiement LLM sur site se situe aux côtés, et non à la place, de l’infrastructure cloud. La bonne architecture pour la plupart des entreprises algériennes est hybride : l’inférence sensible et à haut volume fonctionne sur site ; les charges de travail expérimentales, à faible volume ou en rafale utilisent des API cloud. Cela correspond au modèle adopté mondialement par les industries réglementées — les banques européennes exécutent leurs modèles IA de base sur site tout en utilisant des fournisseurs cloud pour le développement et les tests.

Le timing est favorable. Les prix du matériel GPU ont sensiblement baissé depuis les pics de 2023-2024 et la qualité des modèles open source a convergé avec les modèles cloud propriétaires pour la plupart des tâches d’entreprise. Les entreprises qui construisent une capacité d’inférence IA privée en 2026 auront deux avantages sur celles qui attendent : des coûts à long terme inférieurs à mesure que l’utilisation de l’IA s’intensifie, et une architecture conforme qui ne nécessite pas de remédiation d’urgence lorsque l’application réglementaire rattrapera les déploiements cloud actuels.

Questions Fréquemment Posées

Quel matériel est nécessaire pour exécuter un LLM de production sur site pour une entreprise algérienne ?

Un serveur à 4 GPU NVIDIA H100 ou RTX PRO 6000 Blackwell avec 96 à 384 Go de VRAM combiné est suffisant pour la plupart des déploiements en entreprise algérienne. Cette configuration exécute des modèles jusqu’à 70 milliards de paramètres en précision complète et sert 8 à 12 utilisateurs simultanés à une latence de production. L’analyse de coûts 2026 de VRLA Tech situe le coût total sur 4 ans d’une telle configuration — incluant le matériel et environ 200 $/mois en électricité — bien en dessous des dépenses GPU cloud équivalentes aux taux d’utilisation soutenus.

Quels LLM open source supportent suffisamment bien l’arabe pour les cas d’usage en entreprise algérienne ?

Qwen 2.5 72B d’Alibaba et Llama 3.3 70B de Meta sont les principaux modèles open source pour l’arabe en 2026, Qwen 2.5 se classant régulièrement le mieux sur les benchmarks de traitement du langage naturel arabe. Les deux modèles s’exécutent sur une configuration à 4 GPU et sont licenciés pour le déploiement commercial sans frais par jeton. Pour le traitement de documents en arabe standard (MSA/Fusha), les deux modèles gèrent adéquatement la langue pour les tâches de résumé, traduction et extraction de données structurées.

Le décret 25-320 impose-t-il légalement l’inférence IA sur site aux entreprises algériennes ?

Le décret 25-320 du 30 décembre 2025 établit un cadre national de gouvernance des données couvrant la classification, le catalogage et l’interopérabilité pour les administrations publiques, et la loi 11-25 (juillet 2025) impose des restrictions de transfert transfrontalier dans le régime de protection des données personnelles. Bien qu’aucune des deux lois n’exige explicitement l’inférence sur site, le traitement de données classifiées ou personnelles via une API LLM cloud étrangère crée une exposition à l’audit dans le cadre des deux textes. Les équipes juridiques des entreprises traitant des données gouvernementales, des dossiers financiers ou des données personnelles de citoyens devraient obtenir un avis juridique formel sur la conformité de leur architecture d’inférence cloud actuelle.

—

Sources et lectures complémentaires

- Analyse de coûts LLM sur site vs Cloud 2026 — VRLA Tech

- Déploiement LLM sur site : Coûts réels, compromis et cadre de décision — PremAI Blog

- Gouvernance des données en Algérie : Décret 25-320 et Stratégie Cybersécurité 2025-2029 — AlgeriaTech

- Analyse coût-bénéfice du déploiement LLM sur site — arXiv

- Lois sur la protection des données en Algérie — CMS Expert Guide