Le mur thermique que l'IA a déjà franchi

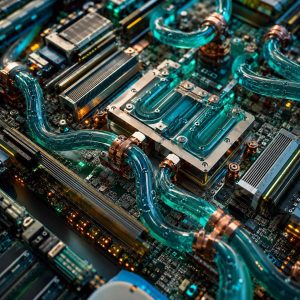

Pendant des années, les opérateurs de datacenters traitaient le refroidissement liquide comme une option exotique pour spécialistes HPC. En 2026, ce cadrage s'est effondré. Les systèmes d'immersion monophasique supportent de façon fiable 200 kW par baie. Les conceptions direct-to-chip à plaques froides sont désormais standard sur toutes les plateformes de référence GPU majeures. Les baies IA de nouvelle génération — construites autour de puces comme NVIDIA Blackwell Ultra et les accélérateurs de classe Rubin — sont spécifiées à 200-250 kW, et les feuilles de route hyperscaler parlent déjà de 300-400 kW comme prochaine étape.

Le refroidissement air, en revanche, plafonne quelque part dans la plage 30-50 kW par baie même avec des échangeurs porte arrière agressifs. Au-dessus, on peut déplacer l'air plus vite et le refroidir plus fort, mais on se bat contre la physique. Comme le résume un condensé largement partagé de Data Center Frontier et Lombard Odier, le refroidissement liquide « n'est plus optionnel pour les hyperscalers ; c'est l'exigence de base pour toute installation destinée à héberger des charges IA modernes. Si vous ne pouvez pas supporter le liquide, vous ne pouvez pas supporter l'IA. »

Ce qui a changé l'économie

Trois choses se sont alignées. D'abord, la densité de puissance GPU a augmenté plus vite que prévu : un H100 à 700 W poussait déjà les limites ; les Blackwell et puces successeurs tournent à 1-2 kW par socket, et des cartes plus denses multiplient cela. Ensuite, les plans capex hyperscaler pour 2026-2028 sont construits sur un doublement ou triplement de la capacité IA, ce qui signifie construire de nouvelles installations plutôt que rénover — et les nouvelles installations sont des opportunités greenfield pour construire liquide-first. Enfin, la courbe de coût des composants de refroidissement liquide s'est améliorée à mesure que les volumes montaient, tandis que le coût énergétique du refroidissement air à forte capacité a empiré.

Les chiffres de taille de marché reflètent le basculement. Les estimations des analystes placent le marché du refroidissement liquide pour datacenters autour de 6,6 milliards USD en 2026, avec une croissance annuelle d'environ 28,7 % jusqu'en 2027. Les prévisions Goldman Sachs et TrendForce citées dans les rapports sectoriels attendent que les baies en refroidissement liquide représentent entre 50 % et 76 % de tous les nouveaux déploiements de serveurs IA d'ici fin 2026 — une fourchette qui, quel que soit le chiffre réel, signale une majorité décisive.

Publicité

Conséquences opérationnelles pour les opérateurs DC

Pour les opérateurs, cela change davantage l'installation que les baies. Un déploiement de refroidissement liquide à grande échelle requiert des unités de distribution de liquide (CDU), des boucles secondaires redondantes, de la détection de fuites, la gestion de la chimie du fluide et des procédures de service pour lesquelles les installations legacy air n'ont jamais été conçues. Les installations à faux-plancher bâties dans les années 2010 manquent fréquemment de la capacité structurelle et du routage sous-plancher pour un rétrofit aisé, raison pour laquelle une grande partie de la construction 2026 est en neuf plutôt qu'en rétrofit.

Capex et opex se redistribuent. L'équipement de refroidissement liquide ajoute du coût initial, mais les améliorations de PUE et la capacité à faire tourner des baies à 200 kW+ signifient que la même empreinte white-space livre beaucoup plus de calcul. Le coût par kW de calcul livré continue de baisser même si le capex par baie monte, ce qui est la logique économique qui rend cette transition inévitable.

Ce que les acheteurs d'entreprise devraient faire

Pour les entreprises qui achètent de la capacité IA plutôt que d'opérer le DC elles-mêmes, trois choses suivent. D'abord, lors de l'évaluation de contrats de colocation ou d'infrastructure IA managée, la capacité de refroidissement liquide est désormais une question de qualification de base, pas un nice-to-have — demandez quelle densité de puissance par baie l'installation supporte aujourd'hui et sur la feuille de route 12 mois. Ensuite, les cadres de reporting de durabilité distinguent de plus en plus entre calcul air et calcul liquide pour les divulgations scope-3 et PUE ; votre équipe ESG le remarquera. Enfin, les clusters IA on-prem ont encore du sens pour certaines charges régulées, mais seulement si votre équipe installations peut crédiblement exécuter un déploiement de refroidissement liquide ; sinon, les services IA managés ou les régions hyperscaler sont le choix pragmatique.

Le prochain point d'inflexion

La prochaine génération d'accélérateurs pousse déjà la discussion au-delà de 300 kW par baie, avec certaines feuilles de route esquissant des conceptions de baies à 1 MW d'ici la fin des années 2020. À ces densités, l'immersion diphasique et les fluides caloporteurs d'ingénierie passent de « niche HPC » à mainstream. Les opérateurs qui complètent bien la transition liquide monophasique en 2026 seront positionnés pour le prochain saut ; ceux qui tentent encore de rénover des installations air continueront à prendre du retard à la fois sur le coût et la capacité.

Questions Fréquemment Posées

Pourquoi les baies IA modernes ne peuvent-elles pas utiliser le refroidissement air ?

Le refroidissement air atteint un plafond pratique autour de 30-50 kW par baie, même avec des échangeurs porte arrière agressifs et un flux d'air à haute vélocité. Les baies IA bâties autour des GPU de génération actuelle (classe Blackwell et successeurs) sont spécifiées à 120-250 kW par baie, avec des feuilles de route pointant vers 300-400 kW. Au-dessus d'environ 100 kW, la physique du déplacement de chaleur par air devient non économique et peu fiable. Le liquide — qu'il s'agisse de plaques froides direct-to-chip ou d'immersion monophasique — déplace environ 1 000 fois plus de chaleur par unité de volume que l'air.

Le refroidissement liquide est-il vraiment plus sûr et plus fiable que l'air ?

Dans les déploiements modernes, oui. Les conceptions direct-to-chip et immersion monophasique incluent détection de fuites, boucles scellées et fluides caloporteurs choisis pour leur stabilité et compatibilité composants. Beaucoup d'hyperscalers rapportent un uptime égal ou meilleur sur les flottes liquides versus la capacité legacy air. Les risques restants — gestion chimie caloporteur, procédures de service, complexité rétrofit — sont des défis opérationnels que l'industrie a largement résolus à grande échelle.

Qu'est-ce que cela signifie pour les entreprises qui n'exploitent pas leurs propres datacenters ?

L'implication principale est que les contrats de colocation et de cloud managé doivent inclure des questions explicites de densité de puissance et de refroidissement. Si votre fournisseur de colocation ne peut pas supporter au moins 100 kW par baie aujourd'hui et n'est pas sur un chemin clair vers 200 kW dans l'année, votre feuille de route IA est contrainte indépendamment des GPU que vous pouvez acheter. C'est désormais une question d'achat de base pour tout contrat d'infrastructure 2026.

Sources et lectures complémentaires

- Liquid Cooling: The 2026 Mandate for 100kW AI Racks — EnkiAI

- Why Liquid Cooling Will Dominate AI Data Centres in 2026 — Lombard Odier

- For AI and HPC, Data Center Liquid Cooling Is Now — Data Center Frontier

- The Boiling Point: Liquid Cooling Becomes the Mandatory Standard as AI Racks Cross 120kW — Financial Content

- Surfs Up! The Liquid Cooling Mandate — AutomatedBuildings